NVIDIA DGX SuperPOD, Rubin 기반 시스템을 위한 무대를 마련한다

I’m happy to translate the article for you, but I’ll need the text you’d like translated. Could you please paste the content (or the portion you want translated) here? I’ll keep the source line exactly as you provided and preserve all formatting, markdown, and technical terms.

Rubin 플랫폼 개요

CES 라스베이거스에서 NVIDIA는 Rubin 플랫폼을 발표했습니다. 이 플랫폼은 단일하고 강력한 AI 슈퍼컴퓨터를 제공하도록 설계된 6개의 새로운 칩 패밀리입니다. 플랫폼은 다음을 가속화하도록 설계되었습니다:

- Agentic AI

- Mixture‑of‑Experts (MoE) 모델

- 장기 컨텍스트 추론

핵심 구성 요소

| Component | Description |

|---|---|

| NVIDIA Vera CPU | AI 워크로드를 위한 고성능 CPU. |

| Rubin GPU | 학습 및 추론에 최적화된 차세대 GPU. |

| NVLink 6 Switch | 칩 간 통신을 위한 고대역폭 인터커넥트. |

| ConnectX‑9 SuperNIC | 고급 네트워킹 인터페이스. |

| BlueField‑4 DPU | 오프로드 및 보안을 위한 데이터 처리 유닛. |

| Spectrum‑6 Ethernet Switch | 데이터센터 연결을 위한 확장 가능한 이더넷 패브릭. |

이 6개의 칩은 고급 codesign approach를 통해 긴밀히 통합되어 다음을 가능하게 합니다:

- 모델 학습을 가속화합니다.

- 추론 토큰 생성 비용을 감소시킵니다.

DGX SuperPOD

DGX SuperPOD 은(는) 기업 및 연구 환경 전반에 걸쳐 Rubin 기반 시스템을 배포하기 위한 기본 설계로 남아 있습니다.

NVIDIA DGX Platform

NVIDIA DGX platform 은 컴퓨팅, 네트워킹, 소프트웨어를 하나의 통합 시스템으로 제공하는 완전한 기술 스택을 제공합니다. 이를 통해 인프라 통합 부담을 없애고 팀이 다음에 집중할 수 있도록 합니다:

- AI 혁신

- 비즈니스 성과

“Rubin은 정확히 적절한 시점에 도착했습니다. AI 컴퓨팅 수요가 학습과 추론 모두에서 급증하고 있기 때문입니다.” — Jensen Huang, 창립자 겸 CEO, NVIDIA

참고 문헌

AI 산업 혁명을 위한 새로운 플랫폼

The Rubin platform은 최신 DGX 시스템에 전력을 공급하며, 지능과 효율성을 단계적으로 끌어올리는 다섯 가지 주요 기술 혁신을 소개합니다.

| # | Advancement | Key Specs & Benefits |

|---|---|---|

| 1 | Sixth‑Generation NVIDIA NVLink | • GPU당 3.6 TB/s • Vera Rubin NVL72 랙당 260 TB/s • 대규모 MoE 및 장기 컨텍스트 워크로드 지원 |

| 2 | NVIDIA Vera CPU | • 88개의 맞춤형 Olympus 코어(Arm v9.2 호환) • 초고속 NVLink‑C2C 연결 • 업계 최고 수준의 효율적인 AI‑factory 연산 제공 |

| 3 | NVIDIA Rubin GPU | • AI 추론을 위한 NVFP4 연산 50 PFLOPS • 하드웨어 가속 압축을 갖춘 3세대 Transformer Engine |

| 4 | Third‑Generation NVIDIA Confidential Computing | • CPU, GPU, NVLink 영역 전반에 걸쳐 엔드‑투‑엔드 기밀성을 제공하는 최초의 랙‑스케일 플랫폼 |

| 5 | Second‑Generation RAS Engine | • GPU, CPU, NVLink 전반에 걸친 실시간 상태 모니터링, 내결함성 및 사전 유지보수 • 모듈식 무선 케이블 트레이로 3배 빠른 서비스 가능 |

Impact: 이러한 혁신을 통해 이전 세대 대비 추론 토큰 비용을 최대 10배까지 절감할 수 있으며, 이는 AI 모델이 규모, 컨텍스트 및 추론 깊이 면에서 지속적으로 성장함에 따라 중요한 이정표가 됩니다.

Source: https://www.nvidia.com/en-us/data-center/dgx-superpod/

DGX SuperPOD: NVIDIA Rubin Scale‑Out 청사진

Rubin 기반 DGX SuperPOD는 최신 NVIDIA 하드웨어와 소프트웨어를 결합해 통합 랙‑스케일 AI 엔진을 제공합니다.

핵심 구성 요소

| 구성 요소 | 역할 |

|---|---|

| NVIDIA DGX Vera Rubin NVL72 또는 DGX Rubin NVL8 시스템 | 컴퓨트 노드 (Rubin GPU, CPU, 메모리) |

| NVIDIA BlueField‑4 DPU | 보안, 소프트웨어 정의 인프라 |

| NVIDIA Inference Context Memory Storage Platform | 저지연 추론 데이터 저장소 |

| NVIDIA ConnectX‑9 SuperNIC | 고성능 네트워킹 |

| NVIDIA Quantum‑X800 InfiniBand 및 NVIDIA Spectrum‑X Ethernet | 초고속 노드 간 통신을 위한 패브릭 |

| NVIDIA Mission Control | 자동 AI 인프라 오케스트레이션 및 운영 |

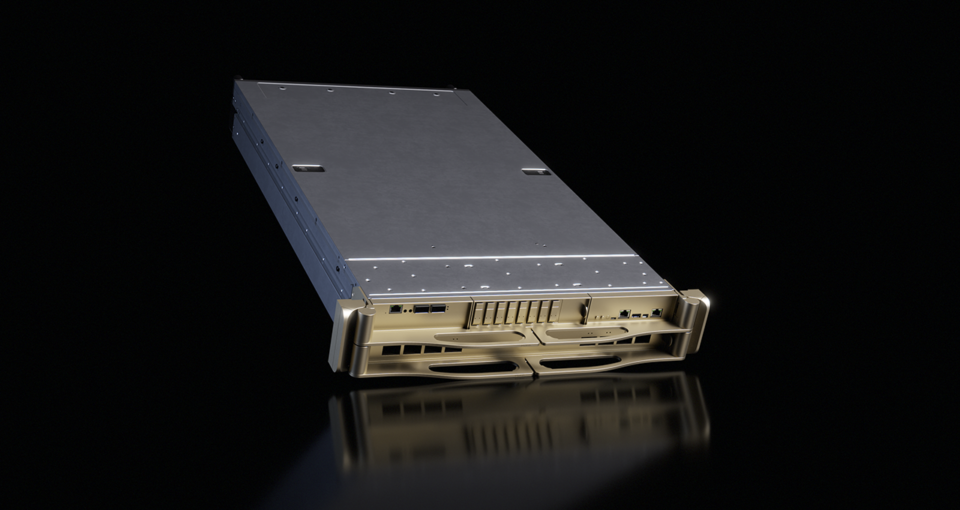

DGX Vera Rubin NVL72와 함께하는 DGX SuperPOD

- 구성: 8 × DGX Vera Rubin NVL72

- GPU 수: 576 Rubin GPU (노드당 72 GPU)

- 성능: 28.8 엑사플롭스 FP4

- 메모리: 600 TB의 고속 메모리 (노드당 75 TB)

- CPU/DPU 구성: 노드당 36 Vera CPU + 18 BlueField‑4 DPU

- 인터커넥트: 260 TB/s 집계 NVLink 처리량 → 모델 파티셔닝을 없애고 랙 전체를 단일 일관된 AI 엔진으로 동작하게 함

핵심 이점: 전체 랙에 걸친 통합 메모리‑컴퓨트 공간을 제공하여 대규모 학습 및 추론 워크로드에 전례 없는 처리량을 실현합니다.

DGX Rubin NVL8와 함께하는 DGX SuperPOD

- 구성: 64 × DGX Rubin NVL8

- GPU 수: 512 Rubin GPU (노드당 8 GPU)

- 노드당 성능: NVIDIA Blackwell 시스템 대비 5.5배 NVFP4 FLOPS (8 Rubin GPU + 6세대 NVLink 덕분)

- 폼 팩터: 액체 냉각, x86‑CPU 기반 섀시 – 개발부터 배포까지 모든 AI 프로젝트에 효율적인 진입점

핵심 이점: 모든 규모의 조직이 Rubin 시대에 진입할 수 있도록 확장 가능하고 에너지 효율적인 시작점 제공.

시각적 개요

모든 사양은 2026년 1월 현재 NVIDIA가 공개한 데이터를 기반으로 합니다.

차세대 AI 팩토리를 위한 네트워킹

Rubin 플랫폼은 혁신적인 네트워킹을 중심으로 고성능 AI 팩토리로 데이터 센터를 재정의합니다:

- NVIDIA Spectrum‑6 Ethernet switches

- NVIDIA Quantum‑X800 InfiniBand switches

- NVIDIA BlueField‑4 DPUs

- NVIDIA ConnectX‑9 SuperNICs

이 구성 요소들은 NVIDIA DGX SuperPOD에 통합되어 전통적인 병목 현상인 규모, 혼잡, 신뢰성을 제거하고 세계에서 가장 대규모 AI 워크로드를 지속적으로 지원합니다.

대규모 클러스터를 위한 최적화된 연결성

800 Gb/s 엔드‑투‑엔드 네트워킹 스위트는 AI 인프라를 위해 두 가지 목적에 맞게 설계된 경로를 제공하여 InfiniBand든 Ethernet이든 최고 효율을 보장합니다.

| 경로 | 주요 특징 | 주요 사용 |

|---|---|---|

| NVIDIA Quantum‑X800 InfiniBand | • AI 클러스터를 위한 최저 지연시간, 최고 성능 네트워킹 • 확장 가능한 계층형 집계 및 축소 프로토콜 (SHARP v4) • 집합 연산을 패브릭으로 오프로드하는 적응형 라우팅 | 초저지연을 요구하는 전용 AI 클러스터 |

| NVIDIA Spectrum‑6 Ethernet | • Spectrum‑6 스위치와 ConnectX‑9 SuperNIC을 기반으로 구축 • 예측 가능하고 고성능의 스케일‑아웃 및 스케일‑크로스 연결성 • AI 워크로드에 일반적인 “동서” 트래픽 패턴에 최적화 | 표준 Ethernet 프로토콜에 의존하는 AI 팩토리 |

기가와트 AI 팩토리 엔지니어링

이러한 혁신은 Rubin 플랫폼과 함께 극한 코드‑디자인을 나타냅니다. 혼잡 제어와 성능 격리를 마스터함으로써 NVIDIA는 차세대 기가와트 AI 팩토리의 물결을 열어가고 있습니다. 이 전체론적 접근 방식은 AI 모델이 복잡해짐에 따라 네트워킹 패브릭이 속도의 촉매가 되고 제약이 되지 않도록 보장합니다.

NVIDIA 소프트웨어가 AI 공장 운영 및 배포를 혁신합니다

NVIDIA Mission Control

무엇인지 – NVIDIA Blackwell 기반 DGX 시스템(또는 Rubin 기반 DGX 시스템)용 AI 기반 데이터센터 운영 및 오케스트레이션 소프트웨어.

주요 기능

- 배포 구성 및 시설 시스템과의 통합을 자동화합니다.

- 클러스터, 워크로드 및 자원 스케줄링을 관리합니다.

인프라 혜택

- NVIDIA Rubin의 냉각 및 전력 이벤트에 대한 제어 강화.

- 복원력 향상 및 사고에 대한 신속한 대응(예: 빠른 누수 감지).

- NVIDIA 최신 효율성 혁신에 대한 접근.

- AI 공장 생산성을 극대화하는 자율 복구.

Read more about NVIDIA Mission Control →

NVIDIA AI Enterprise Platform

지원 대상 – 모든 NVIDIA DGX 시스템.

포함 내용

- NVIDIA NIM – 개발자를 위한 생성형 AI 마이크로서비스 모음.

- NVIDIA Nemotron‑3 제품군과 같은 사전 학습된 오픈 모델.

- 빠른 AI 개발을 위한 관련 데이터, 라이브러리 및 도구.

Explore NVIDIA AI Enterprise →

NVIDIA NIM 마이크로서비스 상세 정보 →

지능형 엔드‑투‑엔드 소프트웨어를 DGX 하드웨어와 결합함으로써, NVIDIA는 기업이 보다 효율적이고 복원력 있으며 관리가 쉬운 AI 공장을 운영할 수 있도록 지원합니다.

DGX SuperPOD: 산업 AI를 위한 향후 로드맵

DGX SuperPOD는 대규모 AI 인프라스트럭처의 청사진으로 오랫동안 활용되어 왔습니다. Rubin 플랫폼의 등장은 수천 단계에 걸쳐 추론하고 비용을 크게 낮춘 인텔리전스를 제공하도록 설계된 새로운 세대 AI 팩토리—프런티어 모델, 멀티모달 시스템, 그리고 에이전시 AI 애플리케이션의 다음 물결을 구축하는 조직을 지원하는 시스템—의 출발점이 될 것입니다.

가용성

NVIDIA DGX SuperPOD와 DGX Vera Rubin NVL72 또는 DGX Rubin NVL8 시스템은 올해 하반기에 제공될 예정입니다.

소프트웨어 제품 정보에 관한 notice 를 확인하십시오.