Hacker News에서 LLM 연구가 감소하고 있다

Source: Hacker News

Overview

요즘 해커 뉴스(HN) 메인 페이지에서 arXiv 논문이 점점 적어지는 걸 느꼈고, 이것이 실제인지 확인하고 싶었습니다.

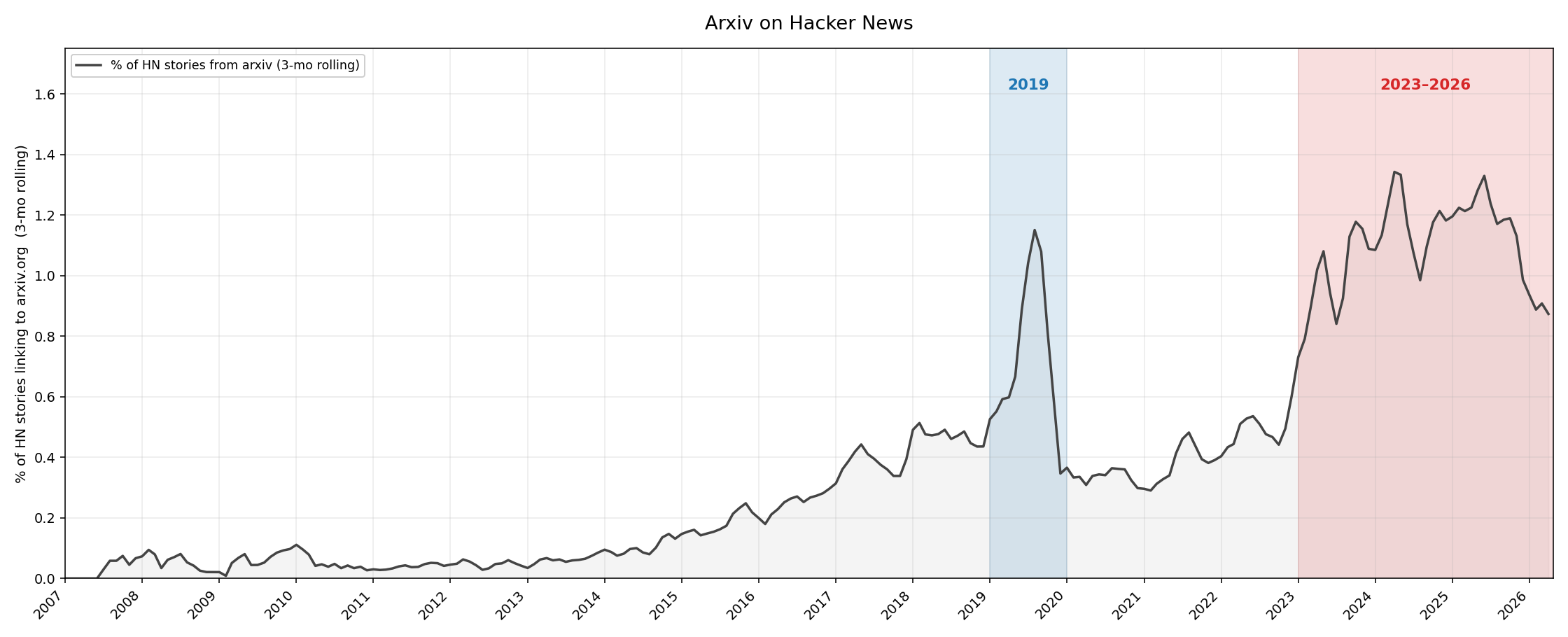

그래서 Claude에게 간단한 분석을 요청했습니다: HN에서 arXiv 스토리의 비율을 시간에 따라 추적하라는 것이었습니다. 그는 BigQuery HN 데이터셋을 쿼리하고, 스토리를 월별로 구분한 뒤 시계열을 그렸습니다:

Percentage of HN stories linking to arXiv – 추세는 내 직감을 확인시켜 줍니다: arXiv 게시물은 지난 몇 달 동안 급격히 감소하고 있습니다. 흥미롭게도 2019년에 또 다른 피크가 있었는데, 이는 추가 조사를 촉발했습니다.

Topic distribution of arXiv stories

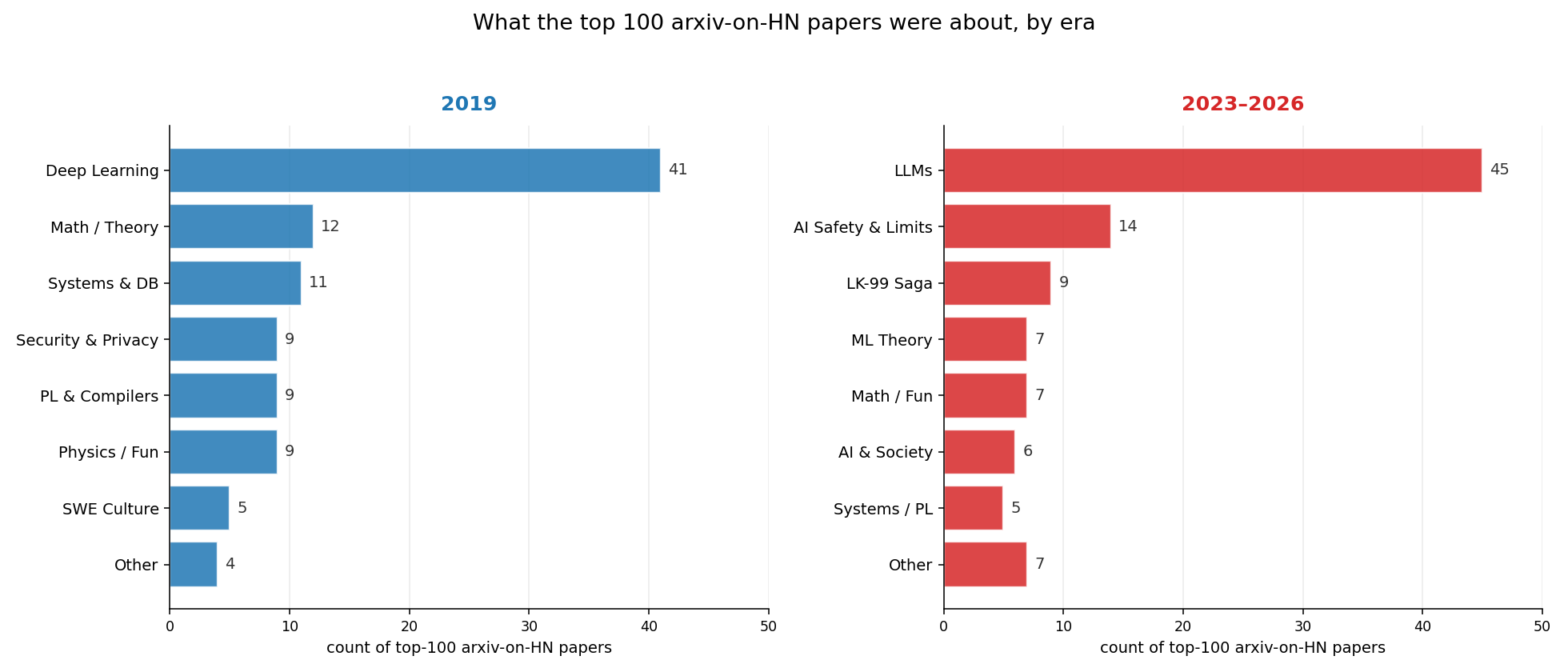

Claude에게 2019년부터 투표 수 상위 100편 논문을 추출하고 주제별로 그룹화해 달라고 요청했습니다. 그때는 딥러닝 피크였으며, 상위 100편 중 41 %가 딥러닝에 관한 것이었습니다. 같은 쿼리를 2023‑2026년에 적용해 보니, 상위 100편 중 59 %가 LLM 또는 AI와 관련되었습니다.

그 결과 차트:

Distribution of topics of arXiv stories

2019 papers that aged well

Claude가 아직도 상위 100편 안에 남아 있는 2019년 논문들을 식별했습니다:

- MuZero — Mastering Atari, Go, Chess and Shogi by Planning with a Learned Model (161 pts) – DeepMind의 AlphaZero 후속작

- EfficientNet — Rethinking Model Scaling for Convolutional Neural Networks (119 pts) – 복합 스케일링, 새로운 CV SOTA 설정

- XLNet — Generalized Autoregressive Pretraining for Language Understanding (79 pts) – 잠시 BERT를 제치던 모델

- PyTorch: An Imperative Style, High-Performance Deep Learning Library (113 pts) – PyTorch 설계를 정형화한 NeurIPS 논문

- On the Measure of Intelligence (80 pts) – Chollet의 ARC / “인간‑유사 지능” 선언문

2023‑2026 papers predicted to hold up

최근 논문이 어느 정도 오래 살아남을지는 아직 이르기 때문에, Claude에게 추측해 보라고 했습니다:

- DeepSeek‑R1 — Incentivizing Reasoning Capability in LLMs via RL (1,351 pts) – 검증 가능한 보상에 순수 RL을 적용한 o1‑스타일 추론 최초 공개 레시피

- Generative Agents — Interactive Simulacra of Human Behavior (391 pts) – 전형적인 “Smallville” 논문, LLM 에이전트 아키텍처 템플릿

- The Era of 1‑bit LLMs — BitNet b1.58, ternary parameters for cost‑effective computing (1,040 pts) – 저비트 추론을 기본으로 삼는 첫 신뢰성 사례

- Differential Transformer (562 pts) – 노이즈‑캔슬링 항을 포함한 어텐션, 실질적인 이론적 스토리를 가진 깔끔한 아키텍처 기여

- LK‑99 cluster — room‑temperature superconductor preprints (2,408 + 1,690 pts) – 물리학이 아닌 메타‑과학의 랜드마크: 초고속 오픈 사이언스와 군중 기반 복제의 전형적인 사례

재미있었습니다. 고맙습니다, Claude.

Citation

BibTeX citation:

@online{castillo2026,

author = {Castillo, Dylan},

title = {LLM Research on {Hacker} {News} Is Drying Up},

date = {2026-04-24},

url = {https://dylancastillo.co/til/llm-research-on-hacker-news-is-dying.html},

langid = {en}

}인용을 위해서는 다음과 같이 표기해 주세요:

Castillo, Dylan. 2026. “LLM Research on Hacker News Is Drying Up.” April 24.