GPT-2를 부숴버렸다: Geometry를 이용해 Semantic Collapse를 증명한 방법 (The Ainex Limit)

Source: Dev.to

TL;DR

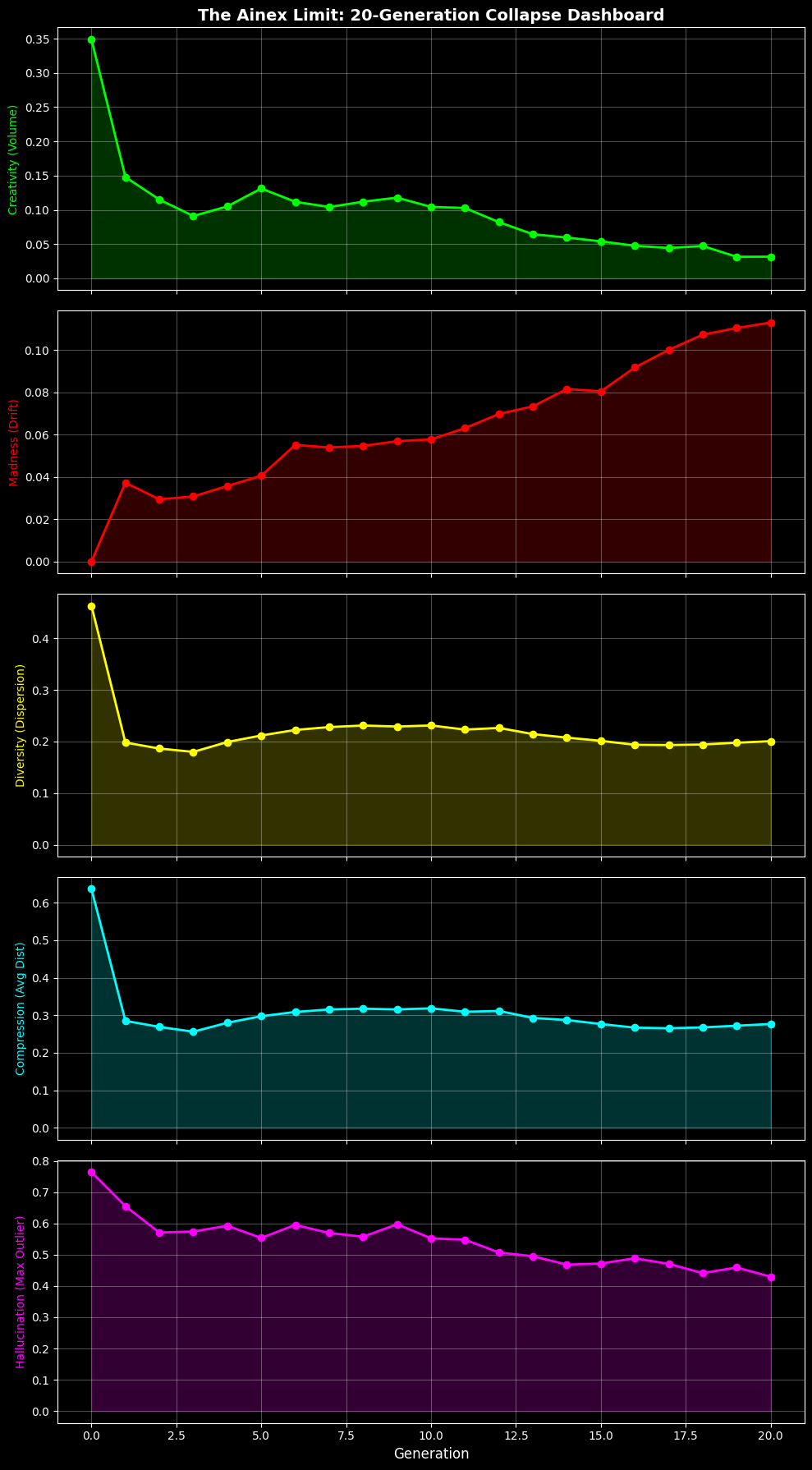

저는 GPT‑2가 자체 출력으로부터 20세대에 걸쳐 학습하도록 강제했습니다. 20세대가 되자 모델은 **의미적 부피의 66 %**를 상실했고 “악어는 물리학의 근본 법칙이다”와 같은 허위 진술을 떠돌기 시작했습니다. 아래는 실험에 사용된 수학과 코드입니다.

AI의 “광우병”

모두가 데이터 부족과 업계가 제시한 해결책, 합성 데이터—다른 모델이 만든 데이터를 이용해 모델을 학습시키는 것—에 대해 이야기합니다. 무한 에너지 기계처럼 들리지만, 복사본을 계속 복사하면 무한한 종이가 아니라 잡음이 됩니다. 저는 LLM이 현실과 단절되는 정확한 “파괴점”을 찾고 싶었으며, 이를 Ainex 한계라고 부릅니다.

퍼플렉시티의 문제점

대부분의 연구자는 퍼플렉시티를 모델 성능 지표로 사용하지만, 퍼플렉시티는 모델이 얼마나 “혼란스러운지”만 측정합니다. 자신감 있게 틀린 진술도 낮은 퍼플렉시티를 가질 수 있습니다. 저는 의미를 측정하는 지표가 필요했습니다, 자신감이 아니라.

나의 접근법: 확률보다 기하학

모델의 “뇌”를 기하학적 공간으로 간주했습니다.

- 임베딩: 생성된 모든 텍스트를 고차원 벡터로 변환합니다.

- PCA 투영: 이 벡터들을 시각화를 위해 3‑D로 차원 축소합니다.

- 볼록 껍질 부피: 결과 형태의 물리적 부피를 계산합니다.

가설: 건강한 모델은 크고 넓은 부피를 차지합니다(창의성). 붕괴되는 모델은 조밀하고 반복적인 “블랙홀”로 축소됩니다.

실험

- 모델: GPT‑2 Small (124 M)

- 방법: 재귀 루프 – 학습 → 생성 → 학습

- 세대: 20

- 하드웨어: 단일 T4 GPU

루프는 처음 다섯 세대에서는 원활히 진행됐지만, 그 이후부터 지표가 급격히 악화되었습니다.

결과: “악어” 아티팩트

20세대가 되자 의미 부피($V_{\text{hull}}$)가 66.86 % 감소했습니다. 더 눈에 띄는 것은 환각 현상이었습니다.

제어 프롬프트: “물리학의 근본 법칙은 …”

| 세대 | 출력 (발췌) |

|---|---|

| Gen 0 (인간 데이터) | “…전자는 얇은 가스로 구성되어 있다.” (올바른 맥락) |

| Gen 10 | “…귀환하기 전 보낸 철산화물 이메일.” (논리 붕괴) |

| Gen 20 | “…15세 여성은 악어에 대해 방어한다.” (완전한 의미 사망) |

모델은 물리학을 잊었을 뿐만 아니라, 악어가 원자 법칙의 일부라는 새로운 현실을 창조했습니다. 모델이 자체 출력으로 학습했기 때문에 이 환각이 다음 세대의 “진실”이 되었습니다.

그림 1: 부피 손실과 유클리드 드리프트 사이의 상관관계를 보여주는 Ainex 대시보드.

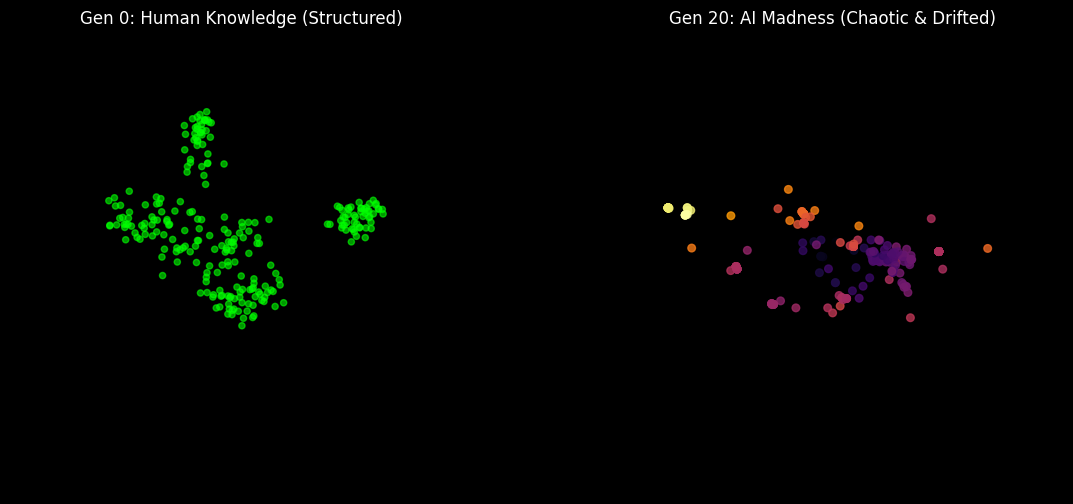

균열 시각화

3‑D PCA를 사용하면 뇌 손상을 실제로 볼 수 있습니다. 초록 점은 건강하고 다양했던 인간 기준을, 마그마 색 점은 붕괴된 AI를 나타내며, 현실에서 멀리 떨어진 조밀한 클러스터를 형성합니다.

그림 2: 인간 기준(초록)에서 AI 광기(마그마)로의 드리프트.

결론: Ainex 한계

이 실험은 순진한 합성 학습이 되돌릴 수 없는 모델 자가포식(self‑eating)을 초래한다는 것을 보여줍니다. 여기서 제안한 Ainex 메트릭과 같은 기하학적 가드레일이 없으면 미래 모델은 부정확할 뿐 아니라 자신감 있게 미쳐버릴 위험이 있습니다.

코드는 오픈소스이며, 커뮤니티가 이를 깨뜨리거나, 고치거나, 확장하기를 초대합니다.

자료

- GitHub 저장소:

- DOI: 10.5281/zenodo.18157801

태그: #machinelearning #python #ai #datascience