企业主对 AI 的期待、为何未能实现,以及规范智能层 (CIL) 如何改变一切

Source: Dev.to

请提供您想要翻译的完整文本(除代码块、URL 之外的内容),我将按照要求将其翻译为简体中文并保留原有的格式。谢谢!

对大多数商业领袖而言,AI 故事始于一个简单的期待

“我想向公司提问,并在几秒钟内得到正确答案。”

- 不是文档。

- 不是仪表盘。

- 不是电子表格。

- 一个答案。

接下来出现的是现代企业技术中最大的期待差距之一。

第一阶段:AI 梦想

当 AI 进入主流时,企业主想象的几乎是组织的数字大脑:

- 提问: “我们上一个 Polpharma 项目的 ROI 是多少?”

- 提问: “哪些客户细分正在变得不盈利?”

- 提问: “我们目前在哪些方面面临监管风险?”

并得到:

- 正确

- 上下文感知

- 授权

- 可解释

的答案 — 立即。

简而言之,他们想象的是 组织智能,而不是聊天机器人。

这个想象中的系统早在 AI 时尚之前就有了名字:

规范化智能层 (CIL) – 公司真实知识的单一、可信赖接口。

第二阶段:第一次失望 — “让我们添加一个聊天机器人”

大多数公司最初尝试的方式很简单:

“在我们的数据之上放一个 AI 聊天界面。”

他们连接了:

- 文档

- PDF 文件

- 电子邮件

- CRM 导出数据

- 仪表盘

并让模型“回答问题”。

他们得到的

- 流畅的回应

- 自信的解释

- 写得很好的摘要

他们没有得到的

- 正确性保证

- 授权控制

- 责任追究

- 随时间保持的一致性

系统可以谈论公司,但它并不了解公司。

为什么会失败

- 语言模型优化的是连贯性,而非真实性。

- 它们不理解所有权、权限或权威。

- 它们无法区分“可用文本”和“允许的知识”。

这不是智能,而是叙述。

第三阶段:第二次失望 — “让我们自行训练模型”

在意识到第三方 AI 可信度不足后,许多公司升级了策略:

“我们将在内部数据上训练自己的 LLM。”

他们投入了:

- Fine‑tuning

- Embeddings

- Private clouds

- Vector databases

- Security wrappers

结果如何?

系统更流畅、更贴合公司,但仍不可靠。

为什么这也会失败

- 训练并不能创造权威。

- 更多数据并不等同于治理。

- Fine‑tuning 并不能产生问责。

- 模型仍然会幻觉——只不过使用的是内部词汇。

模型学会了 公司说话的方式,而不是 公司运作的方式。

核心错误: 用 语言优化工具 去解决 知识架构问题。

基本误解

企业主从未要求更好的语言模型。他们要求的是:

- 决策级别的答案

- 可验证的真相

- 组织记忆

- 受控访问

- 可审计性

换句话说:他们想要 情报,而不是生成。

进入规范智能层(CIL)

CIL 不是 一个模型。它是一个 架构。

CIL 实际是什么

规范智能层是一个系统,它:

- 持有规范化、受治理的公司知识

- 理解谁有权知道什么

- 根据已验证的来源解决问题

- 在回答之前执行授权检查

- 生成带有来源信息的答案

- 记录每一次决策以实现问责

在 CIL 中:

- 知识是 结构化 的

- 真相是 定义 的

- 访问是 强制 的

- 答案是 组装 而非编造

如果使用语言模型,它们也只在边缘——将已验证的输出翻译成人类语言。

为什么这最终能奏效

因为 CIL 与公司实际运作方式相契合:

- 公司不是靠文本运行——它们靠系统运行。

- 它们不信任流畅度——它们信任正确性、权威性和可审计性。

# Rust Controls

- They don’t optimize for creativity — they optimize for risk reduction

- They don’t want “impressive answers” — they want defensible ones

A CIL turns AI from a **confident storyteller** into a **governed enterprise intelligence system**

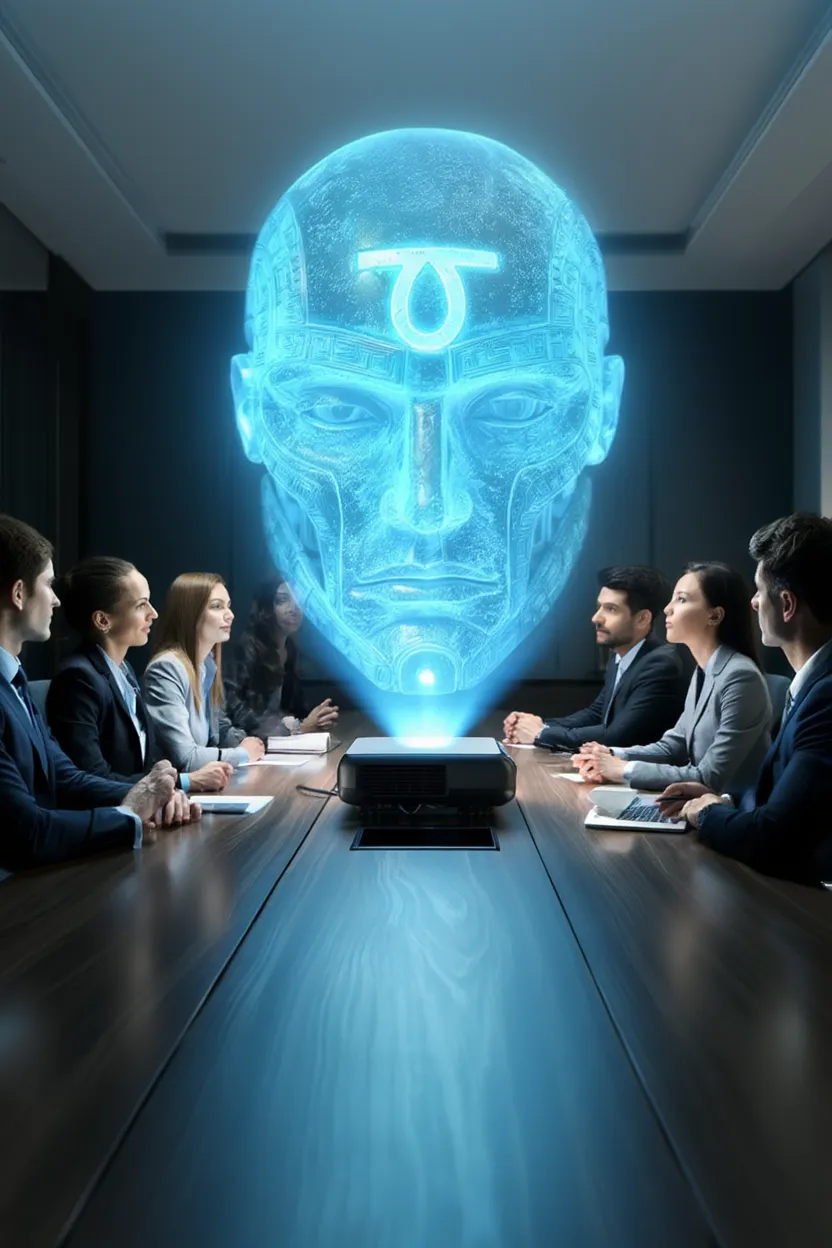

[](https://media2.dev.to/dynamic/image/width=800,height=,fit=scale-down,gravity=auto,format=auto/https%3A%2F%2Fdev-to-uploads.s3.amazonaws.com%2Fuploads%2Farticles%2Fdxq6revonw2543np7otx.png)真正的转变:从 AI 作为大脑到 AI 作为基础设施

企业 AI 的未来 不是:

- 更大的模型

- 更多的参数

- 更多的训练数据

它 是:

- knowledge architecture

- governance runtimes

- controlled intelligence layers

- CIL‑style systems

这就是为什么许多 AI 项目看起来很强大——但在生产环境中失败的原因。

他们试图把法拉利发动机装进卡丁车,然后再加装另一个发动机来让它“安全”。

企业真正需要的是一种 新车辆设计。

最终思考

企业主并不天真。他们的直觉是正确的。

AI 应该能够:

- 回答公司的问题

- 呈现真实的知识

- 在几秒内运行

- 降低认知负荷

- 提升决策质量

错误在于假设仅靠语言模型就能做到这些。但它们做不到!

TauGuard 标准智能层 (CIL) 可以。

这就是以下两者之间的区别:

- 听起来聪明的 AI

- 赢得信任的 AI