OpenAI 的新 GPT-5.5 在 NVIDIA 基础设施上驱动 Codex —— NVIDIA 已经开始投入使用

Source: NVIDIA AI Blog

概述

AI 代理已经彻底改变了开发者的工作流程,而它们的下一个前沿是知识工作:处理信息、解决复杂问题、产生新想法并推动创新。

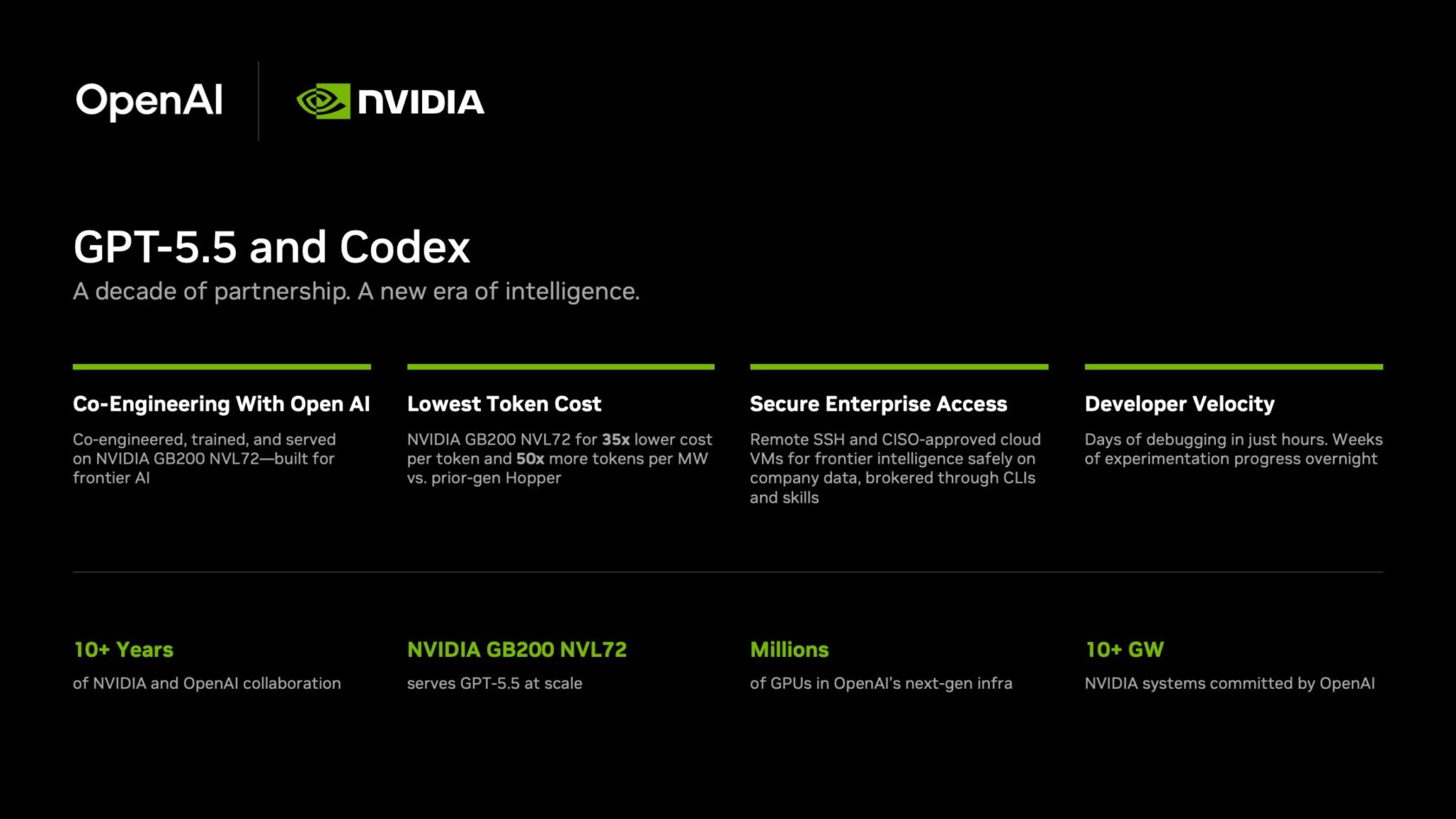

Codex,OpenAI 的代理式编码应用,正在开启这一新前沿。它现在由 GPT‑5.5 提供动力,GPT‑5.5 是 OpenAI 最新的前沿模型,运行在 NVIDIA GB200 NVL72 机架级系统上。

已有超过 10,000 名 NVIDIA 员工——涵盖工程、产品、法务、营销、财务、销售、人力资源、运营以及开发者计划——在使用基于 GPT‑5.5 的 Codex,取得了“令人惊叹”和“改变人生”的成果。

NVIDIA 工程师已经通过 Codex 应用使用 GPT‑5.5 几周,收益是可衡量的。该模型在 GB200 NVL72 上运行,与前代系统相比,每百万 token 成本降低 35 倍,每兆瓦每秒 token 输出提升 50 倍——详见使前沿模型推理在企业规模上可行的经济性分析。

- 曾经需要数天才能完成的调试周期,如今在数小时内即可结束。

- 以前需要数周才能完成的实验,如今在复杂的多文件代码库中可以在一夜之间取得进展。

- 团队能够从自然语言提示直接交付端到端功能,可靠性更强,浪费的周期也比早期模型少。

OpenAI 的进展是 NVIDIA 与所有前沿模型公司合作的最新案例——不仅加速了 NVIDIA 内部的 AI 代理,也帮助合作伙伴为所有人构建世界上最优秀、成本最低、能效最高的模型。

“让我们冲向光速。欢迎来到 AI 时代。” — Jensen Huang,NVIDIA 创始人兼 CEO(全公司邮件)

为企业安全构建的部署

每个代理都需要其专用的计算机。为了确保在安全的企业环境中无缝运行,Codex 应用支持对经批准的云虚拟机进行远程安全外壳(SSH)连接,使代理能够在不对外暴露的情况下使用真实的公司数据。

NVIDIA IT 为每位员工推出了云虚拟机(VM),以安全运行其代理,提供一个保持完整审计性的专用沙箱。用户可以通过熟悉的用户界面控制运行在云 VM 中的 Codex 代理。

零数据保留政策管理 NVIDIA 的部署,代理通过命令行界面和 Skills 以只读权限访问生产系统——这正是 NVIDIA 用于在公司内部运行自动化工作流的同一代理工具包。

十年全栈合作

GPT‑5.5 的发布和 Codex 的推出体现了 NVIDIA 与 OpenAI 十余年的合作。双方的合作始于 2016 年,当时 Jensen Huang 将第一台 NVIDIA DGX‑1 AI 超级计算机亲手送到 OpenAI 位于旧金山的总部。

此后,两家公司在完整的 AI 堆栈上紧密合作:

- NVIDIA 是 OpenAI gpt‑oss 开放权重模型发布的零日合作伙伴,负责为 NVIDIA TensorRT‑LLM 以及包括 vLLM 与 Ollama 在内的生态系统框架优化模型权重。

- OpenAI 承诺在其下一代 AI 基础设施中部署超过 10 GW 的 NVIDIA 系统,将数百万颗 NVIDIA GPU 作为 OpenAI 模型训练和推理的基础,持续多年。

- 双方是早期硅片和共同设计合作伙伴:OpenAI 提供反馈以指导 NVIDIA 的硬件路线图,并提前获取新架构的使用权。这一关系产生了具体里程碑——联合调试首个 GB200 NVL72 10 万 GPU 集群,该集群完成了多次大规模训练任务,并在前沿规模上树立了系统级可靠性的全新基准。

GPT‑5.5 正是该基础设施全力运行的成果。

了解更多,请参阅 OpenAI公告.