Instagram 将在青少年搜索自残和自杀内容时提醒父母

Source: BBC Technology

Instagram 将向父母发出关于青少年自杀相关搜索的警报

使用 Instagram 儿童监督工具的父母将很快收到警报,如果他们的青少年在平台上反复搜索与自杀或自我伤害相关的词语。

这是母公司 Meta 首次主动向父母发出警报,提醒其子女在 Instagram 上搜索有害内容,而不是仅仅阻止搜索并将用户引导至外部帮助。

已加入 Instagram 青少年账户体验的父母和青少年(该体验旨在防止接触有害内容)将从下周起收到这些警报的通知。

但自杀预防慈善机构 Molly Rose 基金会强烈批评此举,警告称它们“可能弊大于利”。

“这项笨拙的宣布充满风险,我们担心强制披露可能弊大于利,”首席执行官 Andy Burrows 说。

“每位父母都想知道自己的孩子是否在挣扎,但这些薄弱的通知会让父母惊慌失措,且没有准备好进行随后敏感且艰难的对话。”

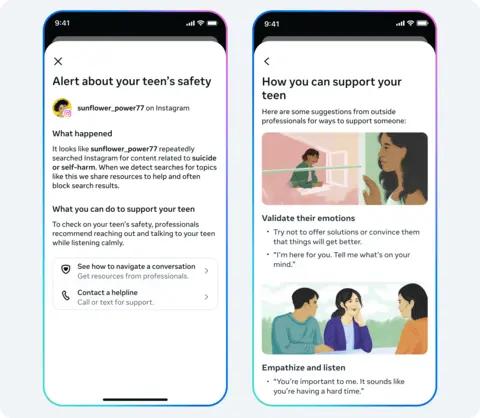

Meta 表示,针对青少年在短时间内在 Instagram 上搜索自杀和自我伤害内容的父母警报,还将附带专家资源,帮助他们与孩子进行困难的对话。

Burrows 引用了该基金会此前的研究,指出 Instagram 仍然“积极”向“易受伤害的年轻人”推荐有关抑郁、自杀和自我伤害的有害内容。

“责任应当在于解决这些风险,而不是再一次以讽刺的时机发布声明,把责任推给父母,”他补充道。

Meta 对该组织去年九月发布的调查结果提出异议,称其“曲解了我们赋能父母、保护青少年的努力”。

警报系统将首先在英国、美国、澳大利亚和加拿大推出,随后在今年稍后在全球其他地区部署。

加强审查

Instagram 青少年账户警报旨在告知父母,若其孩子在平台上的行为和搜索习惯出现突变。

Meta 表示,这些警报建立在 Instagram 现有的青少年保护措施之上,这些措施包括在应用中隐藏与自杀或自我伤害相关的内容,并阻止搜索有害或危险的内容。

警报将通过电子邮件、短信、WhatsApp 或 Instagram 应用本身发送给父母,具体取决于 Meta 拥有的家庭联系信息。

Meta 表示,这就是父母将收到的警报类型。新警报——源自对用户搜索模式的分析——可能偶尔在没有实际问题时通知父母,并将“倾向于谨慎”。

Meta 补充说,在接下来的几个月里,如果青少年在 Instagram 上与 AI 聊天机器人讨论自我伤害和自杀,平台也将尝试使用类似的警报,因为儿童“越来越多地求助于 AI”。

社交媒体公司正面临全球各国政府日益增长的压力,要求其平台对儿童更安全。监管机构和立法者也在密切审查大型科技公司对年轻用户的商业行为。

如果您受到本文所提及问题的影响,可通过 BBC Action Line 获取帮助和支持。