OpenAI의 새로운 GPT‑5.5가 NVIDIA 인프라에서 Codex를 구동 — 그리고 NVIDIA는 이미 이를 활용하고 있다

Source: NVIDIA AI Blog

번역할 텍스트를 제공해 주시면, 요청하신 대로 한국어로 번역해 드리겠습니다. (코드 블록이나 URL은 그대로 유지됩니다.)

Source: …

Overview

AI 에이전트는 개발자 워크플로를 혁신했으며, 그 다음 단계는 지식 작업이다: 정보를 처리하고, 복잡한 문제를 해결하며, 새로운 아이디어를 창출하고, 혁신을 주도하는 일이다.

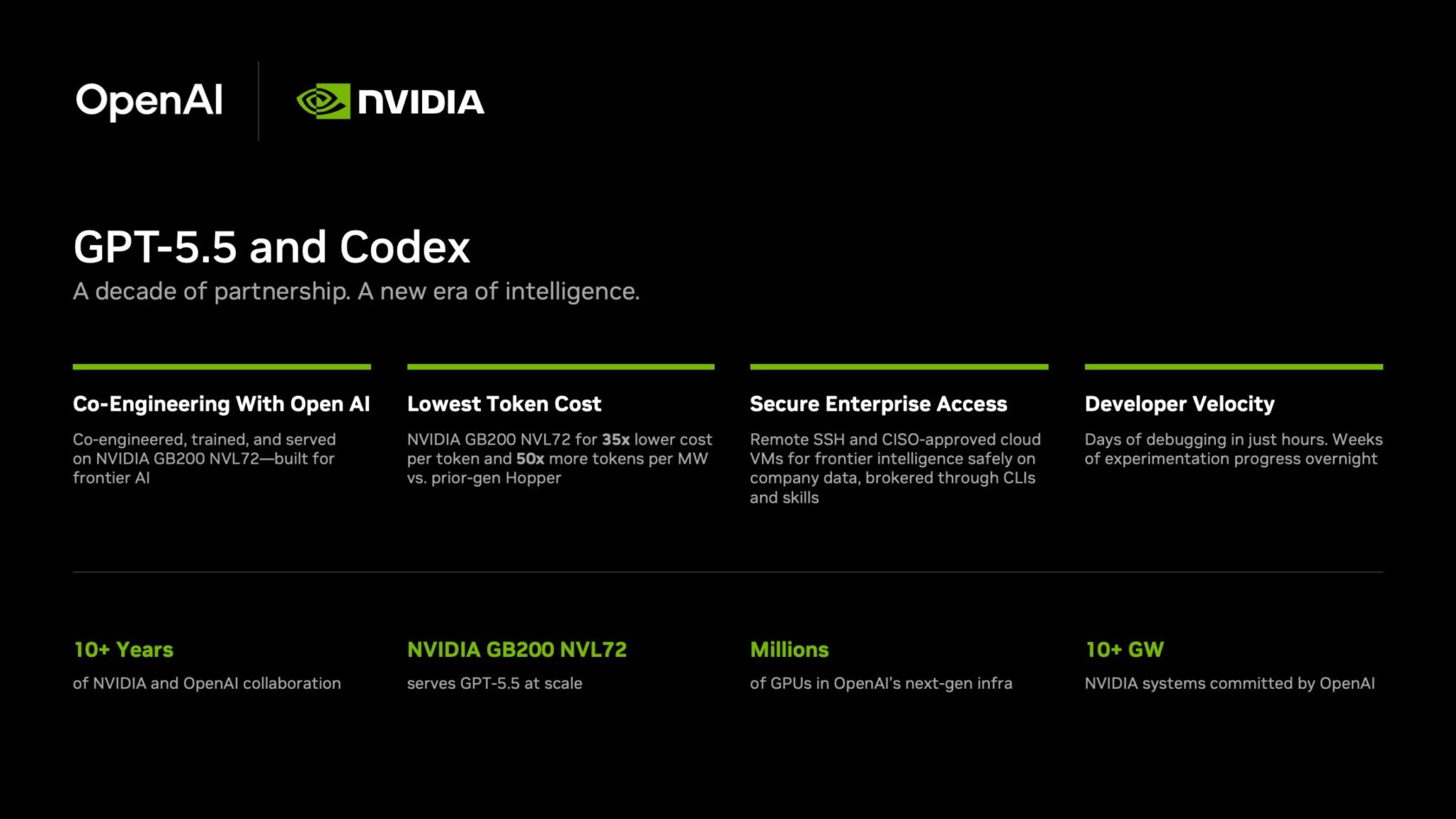

Codex, OpenAI의 에이전시 코딩 애플리케이션은 이 새로운 영역을 가능하게 하고 있다. 현재 GPT‑5.5, OpenAI의 최신 프론티어 모델을 기반으로 하며, NVIDIA GB200 NVL72 랙‑스케일 시스템에서 실행된다.

10,000명 이상의 NVIDIA 직원—엔지니어링, 제품, 법무, 마케팅, 재무, 영업, 인사, 운영, 개발자 프로그램 등 전 분야—이 이미 GPT‑5.5‑기반 Codex를 사용해 “놀라운” 및 “인생을 바꾸는” 결과를 얻고 있다.

NVIDIA 엔지니어들은 몇 주 동안 Codex 앱을 통해 GPT‑5.5에 접근했으며, 그 효과는 측정 가능하다. GB200 NVL72에서 제공되는 35배 낮은 토큰당 비용과 50배 높은 토큰 출력(메가와트당 초당 토큰 수) 은 이전 세대 시스템에 비해 크게 향상된 것으로, 기업 규모에서 프론티어 모델 추론을 가능하게 하는 경제성을 보여준다.

- 며칠 걸리던 디버깅 사이클이 이제는 몇 시간 안에 마무리된다.

- 이전에 몇 주가 걸리던 실험이 복잡한 다중 파일 코드베이스에서도 하룻밤 사이에 진행된다.

- 팀은 자연어 프롬프트만으로 엔드‑투‑엔드 기능을 출시하고 있으며, 이전 모델보다 더 높은 신뢰성과 적은 낭비 사이클을 경험한다.

OpenAI의 진전은 NVIDIA가 모든 프론티어 모델 기업과 협력하여 이룬 최신 사례이다—NVIDIA 내부에서 AI 에이전트를 가속화할 뿐만 아니라, 파트너가 전 세계 최고의, 가장 저비용이며 전력 효율적인 모델을 구축하도록 돕는 것이 목표다.

“빛의 속도로 도약하자. AI 시대에 오신 것을 환영합니다.” — Jensen Huang, NVIDIA 설립자 겸 CEO (전사 이메일)

엔터프라이즈 보안을 위한 배포

모든 에이전트는 자체 전용 컴퓨터가 필요합니다. 보안이 강화된 엔터프라이즈 환경에서 원활한 운영을 보장하기 위해 Codex 앱은 승인된 클라우드 가상 머신에 대한 원격 Secure Shell (SSH) 연결을 지원하며, 이를 통해 에이전트는 외부에 데이터를 노출하지 않고 실제 회사 데이터를 활용할 수 있습니다.

NVIDIA IT는 모든 직원이 에이전트를 안전하게 실행할 수 있도록 클라우드 가상 머신(VM)을 제공했으며, 전용 샌드박스를 통해 완전한 감사 가능성을 유지합니다. 사용자는 익숙한 사용자 인터페이스를 통해 클라우드 VM에서 실행 중인 Codex 에이전트를 제어할 수 있습니다.

NVIDIA의 배포는 제로 데이터 보존 정책에 따라 운영되며, 에이전트는 명령줄 인터페이스와 Skills를 통해 읽기 전용 권한으로 프로덕션 시스템에 접근합니다. 이는 NVIDIA가 회사 전반에 걸쳐 자동화 워크플로를 실행하는 데 사용하는 동일한 에이전시 툴킷입니다.

Source:

풀스택 협업 10년

GPT‑5.5 출시와 Codex 롤아웃은 NVIDIA와 OpenAI 간 10년 이상의 협업을 반영합니다. 파트너십은 2016년, Jensen Huang가 첫 NVIDIA DGX‑1 AI 슈퍼컴퓨터를 직접 OpenAI 샌프란시스코 본부에 전달하면서 시작되었습니다.

그 이후 두 회사는 전체 AI 스택 전반에 걸쳐 긴밀히 협력해 왔습니다:

- NVIDIA는 OpenAI의 gpt‑oss 오픈‑웨이트 모델 출시를 위한 day‑zero 파트너로서, 모델 가중치를 NVIDIA TensorRT‑LLM 및 vLLM, Ollama와 같은 생태계 프레임워크에 최적화했습니다.

- OpenAI는 차세대 AI 인프라를 위해 10 GW 이상의 NVIDIA 시스템을 배치하기로 약속했으며, 수백만 개의 NVIDIA GPU가 앞으로 수년간 OpenAI 모델 학습 및 추론의 기반이 될 것입니다.

- 양사는 초기 실리콘 및 공동 설계 파트너입니다. OpenAI는 NVIDIA의 하드웨어 로드맵에 영향을 주는 피드백을 제공하고, 새로운 아키텍처에 조기 접근 권한을 얻습니다. 이 관계는 구체적인 이정표를 만들었는데, 바로 첫 GB200 NVL72 100,000‑GPU 클러스터를 공동 구축한 것입니다. 이 클러스터는 여러 대규모 학습 작업을 완료했으며, 최첨단 규모에서 시스템 수준 신뢰성의 새로운 기준을 세웠습니다.

GPT‑5.5는 이러한 인프라가 전력을 다해 가동된 결과물입니다.

자세한 내용은 OpenAI 발표를 참고하세요.