LLMs는 대규모로 가명 사용자를 놀라운 정확도로 식별할 수 있다

Source: Ars Technica

실험 개요

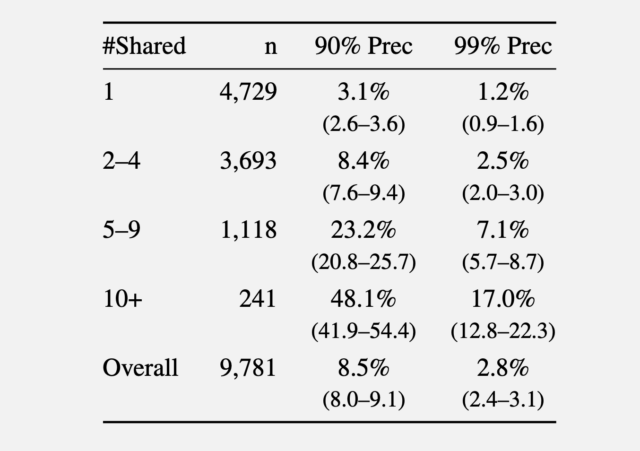

다양한 정밀도 임계값에서의 재현율.

세 번째 실험에서 연구원들은 Netflix 데이터셋에서 5,000명의 사용자를 선택하고, 결과에 포함되지 않은 사람들의 “산만함” 정체성 5,000개를 추가했습니다. 그런 다음 10,000개의 후보 프로필 목록에 쿼리 세트에만 나타나는 사용자 5,000명의 쿼리 산만 요소를 추가했으며, 후보 풀에는 실제 매치가 없습니다.

결과

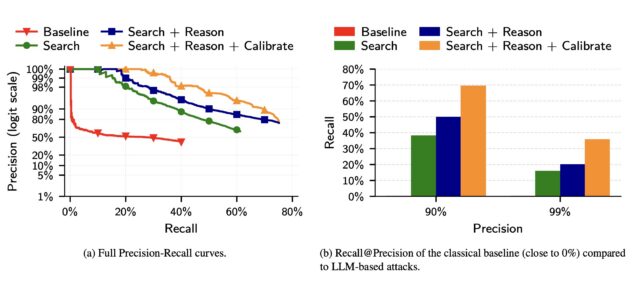

정밀도 곡선.

연구원들은 다음과 같이 적었습니다:

(a) 고전적인 공격의 정밀도는 매우 빠르게 떨어져 낮은 재현율을 설명합니다. 반면, LLM 기반 공격의 정밀도는 공격자가 더 많은 추측을 할수록 더 완만하게 감소합니다.

(b) 고전적인 공격은 중간 정도의 낮은 정밀도에서도 거의 완전히 실패합니다. 반면, 가장 단순한 LLM 공격(검색)조차도 낮은 정밀도에서 비트리비얼한 재현율을 달성하고, Reason 및 Calibrate 단계를 추가하면 99% 정밀도에서 재현율이 두 배가 됩니다.

결과는 LLM이 여전히 오탐 및 기타 약점에 취약하지만, 온라인 사용자를 식별하는 전통적인 자원 집약적 방법보다 빠르게 앞서 나가고 있음을 보여줍니다.

완화 방안

연구원들은 다음과 같은 여러 완화 방안을 제안했습니다:

- 플랫폼이 사용자 데이터에 대한 API 접근에 속도 제한을 적용합니다.

- 자동 스크래핑을 감지하고 대량 데이터 내보내기를 제한합니다.

- LLM 제공업체가 익명 해제 공격에 대한 모델 오용을 모니터링하고, 모델이 이러한 요청을 거부하도록 방어 장치를 구축합니다.

함의

LLM의 익명 해제 성공률이 향상될 경우, 연구원들은 다음과 같이 경고합니다:

- 정부가 이 기술을 사용해 온라인 비평가의 신원을 밝힐 수 있습니다.

- 기업이 “초맞춤형 광고”를 위해 고객 프로필을 구성할 수 있습니다.

- 공격자가 대규모로 대상 프로필을 구축해 고도로 개인화된 사회공학 사기를 실행할 수 있습니다.

“LLM 능력의 최근 발전은 LLM 기반 공격 사이버 역량이 등장함에 따라 컴퓨터 보안의 다양한 측면을 재고할 긴급한 필요성을 명확히 보여줍니다,” 라고 연구원들은 경고했습니다. “우리의 연구는 프라이버시에도 동일한 상황이 적용될 가능성이 높다는 것을 보여줍니다.”