Instagram, 청소년이 자해 및 자살 관련 콘텐츠를 검색하면 부모에게 알림

Source: BBC Technology

Instagram, 청소년 자살 관련 검색에 대해 부모에게 알림

Instagram의 자녀 감독 도구를 사용하는 부모는 이제 청소년이 플랫폼에서 자살이나 자해와 관련된 용어를 반복적으로 검색할 경우 알림을 받게 됩니다.

이는 모회사 Meta가 해로운 자료에 대한 검색을 차단하고 외부 도움을 안내하는 대신, 자녀가 Instagram에서 검색한 내용을 사전에 부모에게 알리는 첫 사례입니다.

해로운 콘텐츠 노출을 방지하기 위해 설계된 Instagram의 ‘Teen Accounts’ 경험에 등록된 부모와 청소년은 다음 주부터 이 알림을 받게 됩니다.

하지만 자살 예방 자선단체인 몰리 로즈 재단(Molly Rose Foundation)은 이 조치가 “오히려 해를 끼칠 수 있다”고 강하게 비판했습니다.

“이 서투른 발표는 위험 요소가 많으며, 강제적인 공개가 오히려 해를 끼칠 수 있다는 점이 우려됩니다.”라고 재단의 최고경영자 앤디 버로스(Andy Burrows)가 말했습니다.

“모든 부모는 자녀가 어려움을 겪고 있는지 알고 싶어하지만, 이런 형편없는 알림은 부모를 당황하게 하고 이후에 이어질 민감하고 어려운 대화를 준비하지 못하게 할 것입니다.”

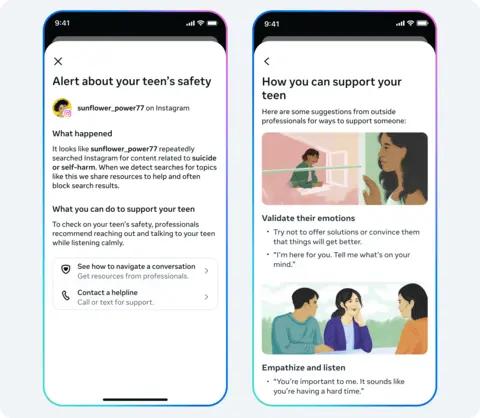

Meta는 Instagram에서 자살 및 자해 관련 자료를 짧은 시간 안에 검색한 경우 부모에게 알림과 함께 전문가 자료를 제공해, 자녀와의 어려운 대화를 어떻게 진행할지 돕겠다고 밝혔습니다.

버로스는 재단이 이전에 수행한 연구(링크)를 인용하며, Instagram이 여전히 “우울증, 자살, 자해”와 같은 해로운 콘텐츠를 “취약한 청소년”에게 적극적으로 추천하고 있다고 지적했습니다.

“이러한 위험을 해결하는 데 초점을 맞춰야 하며, 또다시 부모에게 책임을 떠넘기는 시기적절하지 않은 발표를 하는 것이 아니라는 점을 강조하고 싶습니다.”라고 그는 덧붙였습니다.

Meta는 지난해 9월 발표된 재단의 연구 결과가 “우리의 부모 지원 및 청소년 보호 노력에 대한 오해를 불러일으킨다”고 반박했습니다.

이 알림 시스템은 처음에 영국, 미국, 호주, 캐나다에서 시행된 뒤, 연말까지 전 세계 다른 지역에도 확대될 예정입니다.

증가하는 감시

Instagram의 ‘Teen Account’ 알림은 부모에게 자녀의 행동 및 검색 습관에 급격한 변화가 감지될 경우 알려주기 위해 설계되었습니다.

Meta는 이 기능이 기존의 Instagram 청소년 보호 조치를 기반으로 한다고 설명했습니다. 기존 조치에는 앱 내에서 자살·자해 관련 자료를 숨기고, 해롭거나 위험한 콘텐츠 검색을 차단하는 것이 포함됩니다.

알림은 부모가 제공한 연락처 정보에 따라 이메일, 문자, WhatsApp 또는 Instagram 앱 자체를 통해 전달됩니다.

Meta는 이러한 알림이 부모가 받을 수 있는 예시라고 밝혔습니다. 사용자 검색 패턴 분석을 기반으로 하는 새로운 알림은 때때로 실제 위험이 없을 때도 부모에게 통보될 수 있으며, “조심스러운 편을 택한다”고 설명했습니다.

또한 Meta는 앞으로 몇 달 안에 청소년이 Instagram의 AI 챗봇과 자해·자살에 대해 대화할 경우에도 유사한 알림을 적용할 계획이라고 덧붙였습니다. 이는 아이들이 “점점 더 AI에 의존해 지원을 구하고 있기” 때문입니다.

전 세계 정부는 소셜 미디어 기업에게 어린이에게 더 안전한 플랫폼을 만들도록 압력을 가하고 있습니다. 규제 기관과 입법자들은 동시에 대형 기술 기업의 청소년 대상 사업 관행을 면밀히 조사하고 있습니다.

이 기사와 관련된 문제로 어려움을 겪고 있다면, BBC Action Line을 통해 도움과 지원을 받을 수 있습니다.