나는 AI 에이전트를 위해 Control Plane을 구축했다 — 같은 실수를 계속 반복했기 때문에

I’m happy to translate the article for you, but I’ll need the full text you’d like translated. Could you please paste the content (excluding the source line you’ve already provided) here? Once I have it, I’ll translate it into Korean while preserving the original formatting and markdown.

아무도 이야기하지 않는 세 가지 문제

무슨 일을 하고 있는지 전혀 모른다.

로그를 추적하고, 터미널 출력을 스크롤하면서 내가 잠든 사이에 무슨 일이 있었는지 파악하려 애쓴다. 에이전트가 8시간 동안 실행되었다. 무엇을 성취했을까? 아무도 모른다.같은 실수를 반복한다.

지난 주에pkill -f를 사용해 시스템을 다운시켰다. 하지 말라고 말했는데 다음 세션에서도 같은 실수를 반복한다. 모든 대화가 처음부터 시작된다.잘못된 일을 할 때, 너무 늦게 알게 된다.

20분이면 끝났을 작업을 3시간 동안 빙빙 돌며 시간을 낭비한다. 내가 명시적으로 금지한 패키지를 설치하고, 깨진 코드를 푸시한다. 내가 눈치채는 순간에는 이미 끝난 뒤였다.

해결책: 에이전트가 자체 상태를 보고하도록 만들기

I built Evolve — a control plane for autonomous AI agents.

핵심 인사이트: 에이전트를 외부에서 모니터링하지 마세요. 에이전트가 스스로를 모니터링하도록 하세요.

# The agent reports: "I'm coding, 40% done"

curl -X POST $EVOLVE_URL/api/agent/heartbeat \

-d '{"activity":"coding","description":"implementing auth module","progress_pct":40}'

# The agent reports: "I discovered something important"

curl -X POST $EVOLVE_URL/api/agent/discovery \

-d '{"title":"Rate limit found","content":"Max 3 posts/day","priority":"high"}'

# The agent reports: "Here's what I learned today"

curl -X POST $EVOLVE_URL/api/agent/review \

-d '{"accomplished":["API integration"],"learned":["Use MD5 not SHA256"]}'규칙은 간단합니다: 보고가 없으면 작업이 존재하지 않는 것입니다. 이것은 에이전트 프롬프트에 내장되어 있습니다. 에이전트는 반드시 이 API들을 호출해야 하며, 그렇지 않으면 작업이 인정되지 않습니다.

여섯 개의 보고 엔드포인트가 모든 것을 포괄합니다: Heartbeat, Deliverable, Discovery, Workflow, Upgrade Proposal, 그리고 Review.

Source: …

모든 것을 바꾼 부분: 지속되는 지식

이것이 핵심 혁신입니다. 대부분의 에이전트 프레임워크는 매 대화마다 처음부터 시작합니다. Evolve는 폐쇄‑루프 학습 시스템을 구축합니다:

flowchart TD

A[Agent makes mistake] --> B[Reports via review API]

B --> C[LLM evaluates: "10/10 critical lesson"]

C --> D[Stored in layered knowledge base]

D -->|Permanent (score ≥8)| E[Core lessons, never expire]

D -->|Recent (5‑7)| F[Useful but temporal, 30‑day TTL]

D -->|Task| G[Matched to current work context]

E & F & G --> H[Next startup: Injected into prompt]

H --> I[Agent never makes that mistake again]주요 설계 결정

- 저장이 아니라 정제. 보조 LLM이 각 교훈을 1‑10점으로 평가하고, 한 문장으로 요약하며 태그를 붙입니다. 원시 데이터는 저장되고, 실행 가능한 지식만이 추출됩니다.

- 3계층 주입. 가장 관련성 높은 지식만 프롬프트에 삽입됩니다. 모든 것을 넣으면 컨텍스트 윈도우가 폭발하기 때문입니다.

- 자동 만료. 가치가 낮은 지식은 30 일 후에 자동으로 사라져, 지식 베이스를 가볍게 유지합니다.

AI가 AI를 검토한다

하나의 에이전트가 작업하고, 다른 에이전트가 그 작업을 검토합니다.

워크플로우

- 대시보드에서 Analyze 버튼을 클릭합니다.

- Evolve가 전체 대화 로그(JSONL)를 읽습니다.

- 핵심 행동을 추출하고 약 6000자 정도로 압축합니다.

- 요약을 보조적인, 더 저렴한 LLM에 보내 분석합니다.

검토자는 다음과 같은 질문에 답합니다:

- 각 결정이 합리적이었는가?

- 불필요한 루프나 낭비된 노력이 있었는가?

- 지침을 따랐는가?

- 효율성 점수 및 개선 제안

검토자가 더 저렴한 모델(Claude가 아님)을 사용하기 때문에 비용이 최소화됩니다.

24/7 서바이벌 엔진

| 기능 | 설명 |

|---|---|

| Watchdog | 10초마다 건강 검사를 수행합니다. 멈추었나요? 자동으로 복구됩니다. |

| Heartbeat detection | 5분 침묵 → 부드러운 알림. 15분 → 상황 인식 개입. |

| Crash recovery | --resume 옵션으로 재시작하고, 이전 지식을 주입하여 끊김 없이 계속합니다. |

| Web terminal | 브라우저에서 tmux 세션을 조작합니다. SSH가 필요 없습니다. |

런타임 권한 제어

대시보드에서 에이전트가 할 수 있는 일을 토글합니다—재시작 필요 없고, 코드 변경도 필요 없습니다.

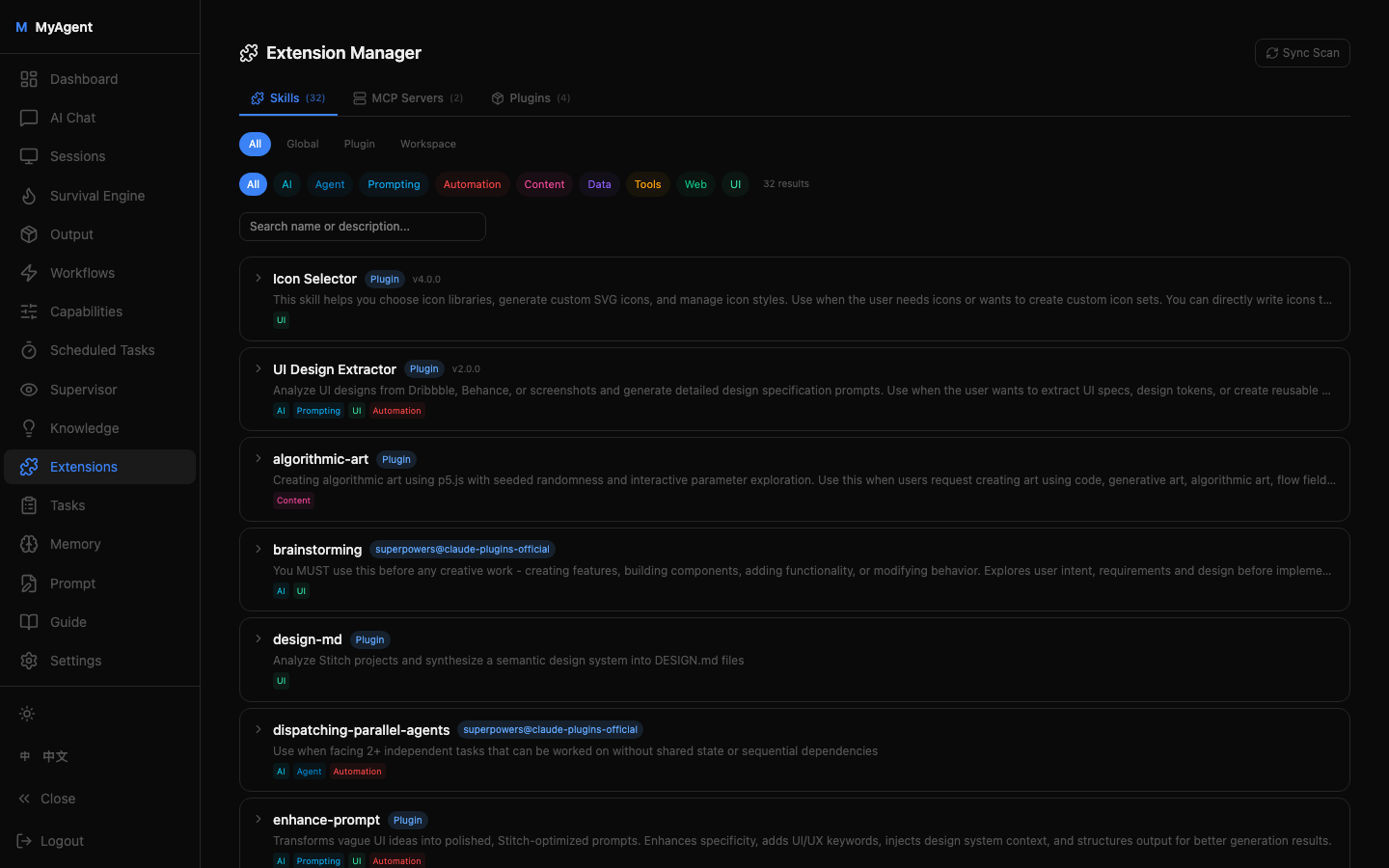

확장 관리

맞춤 확장을 관리하고, 새로운 기능을 추가하며, 사용량을 동일한 인터페이스에서 모니터링합니다.

스킬, MCP 서버, 플러그인에 대한 전체 가시성을 제공하며 — 자동 태깅 및 소스 추적이 포함됩니다.

하네스 엔지니어링

I call this approach Harness Engineering — building infrastructure that wraps, constrains, and amplifies AI models.

Traditional: Better Model → Better Results

Harness Eng: Same Model + Better Harness → Dramatically Better ResultsThe model is a commodity. Two teams using the same Claude will get wildly different results based on their harness quality. Evolve is that harness.

사용해 보기

git clone https://github.com/xmqywx/Evolve.git

cd Evolve

python -m venv .venv && .venv/bin/pip install -r requirements.txt

cd web && npm install && npm run build && cd ..

cp config.yaml.example config.yaml

.venv/bin/python run.py

# Visit http://localhost:3818스택: Python/FastAPI 백엔드, React/TypeScript 프론트엔드, SQLite, xterm.js, Claude Code 런타임.

MIT licensed. GitHub →

If you’re running AI agents in production and are tired of babysitting them, give Evolve a try. I’d love to hear how you’re solving these same problems.