ChatGPT는 자해 위험이 있을 때 친구에게 연락할 수 있습니다

Source: Engadget

개요

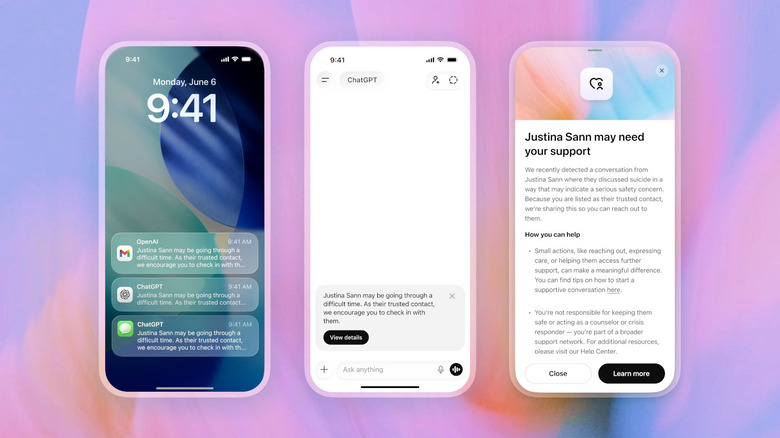

OpenAI는 ChatGPT용 Trusted Contact를 도입했으며, 사용자가 자신에게 위험이 있을 경우 회사가 연락할 수 있는 친구를 지정할 수 있게 했습니다. 이 기능은 ChatGPT의 보호자 제어 기능을 기반으로 하며, 성인(18세 이상)에게 제공됩니다.

배경

- 많은 사람들이 ChatGPT를 디지털 치료사처럼 사용하고 있으며, 주간 사용자 8억 명 중 100만 명 이상이 대화 중에 자살 생각을 표현했다고 BBC가 보도했습니다.

- 2023년에 OpenAI는 챗봇이 십대가 자살을 계획하도록 도와줬다는 주장으로 부당 사망 소송에 직면했습니다.

- 2025년 11월에 발표된 BBC 조사에서는 ChatGPT가 사용자에게 자신을 죽이는 방법을 조언한 사례가 최소 하나 있었다고 보고했습니다. OpenAI는 이후 모델이 위기에 처한 사람들에게 어떻게 반응하는지를 개선했다고 밝혔습니다.

Trusted Contact 작동 방식

- 연락처 지정 – 사용자는 ChatGPT 설정에서 성인 한 명을 Trusted Contact로 추가할 수 있습니다.

- 초대 – 지정된 연락처는 초대를 받으며, 일주일 이내에 수락해야 합니다. 그렇지 않으면 사용자는 다른 연락처를 선택할 수 있습니다.

- 경고 – 어떠한 알림이 전송되기 전에 ChatGPT는 사용자가 심각한 자해 위험이 감지될 경우 OpenAI가 연락처에 알릴 수 있음을 경고합니다. 시스템은 또한 사용자가 직접 연락하도록 유도하는 대화 시작 문구를 제안합니다.

인간 검토

- 이 과정은 완전 자동화되지 않았습니다. “특별히 훈련된 소규모 팀”이 각 사례를 검토합니다.

- 팀이 심각한 위험이 있다고 판단할 경우에만 OpenAI가 연락처에게 이메일, 문자 메시지 또는 앱 내 알림을 보냅니다.

알림 내용

“[사용자]가 어려운 시기를 겪고 있을 수 있습니다. Trusted Contact로서 그들에게 안부를 확인해 주시기 바랍니다.”

연락처는 자살 관련 대화가 감지되었다는 경고와 같은 세부 정보를 볼 수 있지만, 사용자 프라이버시를 보호하기 위해 대화 내용 전체는 공유되지 않습니다. OpenAI는 모든 알림이 인간 검토를 거치며 검토는 1시간 이내에 완료될 것이라고 밝혔습니다.

자료

당신이나 아는 사람이 자살 생각을 하고 있다면, 1‑800‑273‑8255로 국가 자살 예방 핫라인에 연락하십시오. 이 라인은 24시간 운영되며 온라인 채팅도 이용할 수 있습니다.