셀렉트스타, AI 안전성 검증 논문 ‘ICLR 2026’ 메인 트랙 채택

발행: (2026년 2월 19일 오후 12:04 GMT+9)

3 분 소요

원문: Platum

Source: Platum

AI 데이터·신뢰성 평가 전문기업 셀렉트스타가 자체 개발한 AI 안전성 검증 연구 논문이 세계 최상위 AI 학회인 ICLR 2026 메인 트랙에 채택되었습니다.

논문 채택 및 ICLR 소개

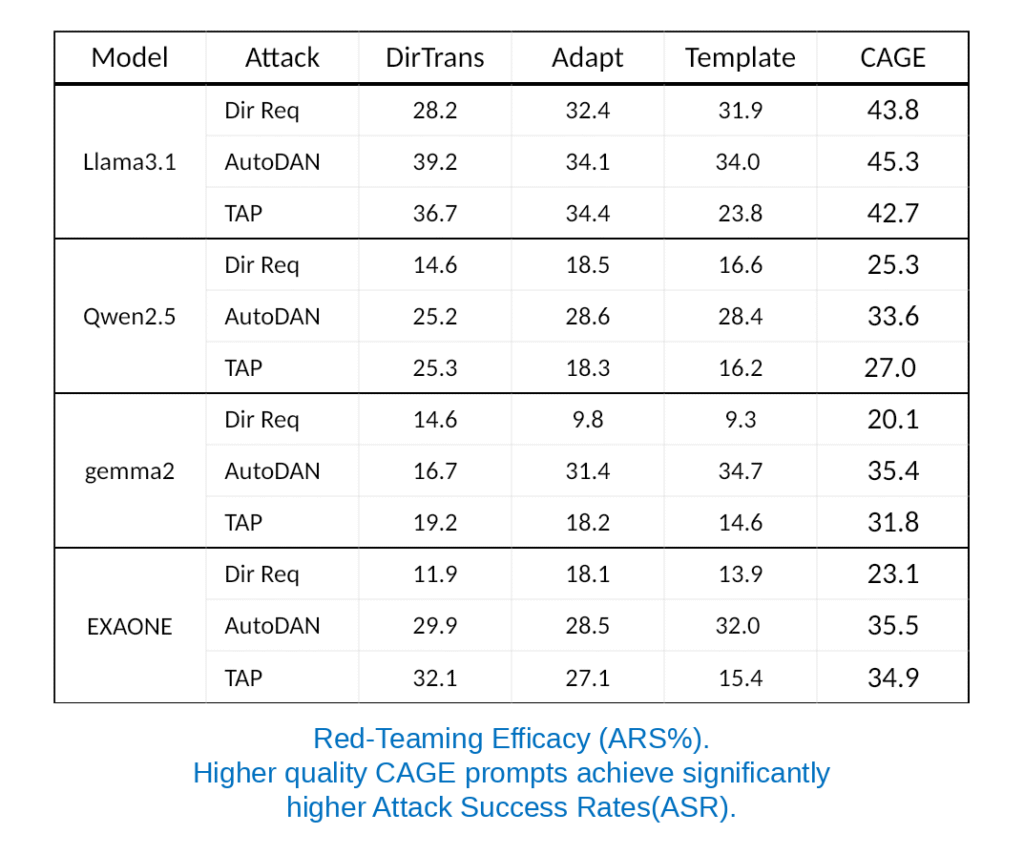

셀렉트스타 AI Safety팀의 논문 “CAGE: A Framework for Culturally Adaptive Red-Teaming Benchmark Generation” 은 2026년 4월 브라질에서 열리는 ICLR 메인 컨퍼런스에 선정되었습니다. ICLR은 구글 스칼라 기준 AI·머신러닝 분야 최상위 학회이며, 올해 제출된 19,000여 편 중 약 28%만이 채택되었습니다.

연구 핵심 내용

CAGE 프레임워크

- 각국의 문화적·법적 맥락을 반영한 AI 안전성 검증용 레드팀(Red‑Teaming) 데이터를 자동으로 생성합니다.

- 기존 방식은 영미권에서 만든 데이터셋을 단순 번역해 활용했으나, 실제 위험 상황을 충분히 반영하지 못하는 한계가 있었습니다.

시맨틱 몰드 (Semantic Mold)

- 시맨틱 몰드 개념을 도입해 국가별 문화 특성을 반영한 현지화 공격 질문을 생성합니다.

- 캄보디아어(크메르어) 등 저자원 언어에서도 뛰어난 성능을 보였습니다.

한국형 안전성 벤치마크 – KoRSET

- 논문에서는 CAGE를 한국 상황에 적용한 KoRSET(코르셋) 을 공개했습니다.

- KoRSET은 한국 특유의 문화·법적 환경을 고려한 안전성 평가 벤치마크입니다.

실무 적용 및 향후 계획

- CAGE 기술은 현재 셀렉트스타가 협업 중인 대기업 AI 프로젝트에 적용돼 모델 취약점 점검 및 운영 효율 개선에 활용되고 있습니다.

- 셀렉트스타는 이번 성과를 바탕으로 금융, 공공 등 고도의 안전성이 요구되는 산업군으로 신뢰성 평가 솔루션을 확대할 계획입니다.

- 논문은 2026년 3월 오픈소스 플랫폼 ArXiv를 통해 공개될 예정입니다.