AI 에이전트 SNS ‘몰트북’ 보안 논란, 왜 위험한가?

Source: Byline Network

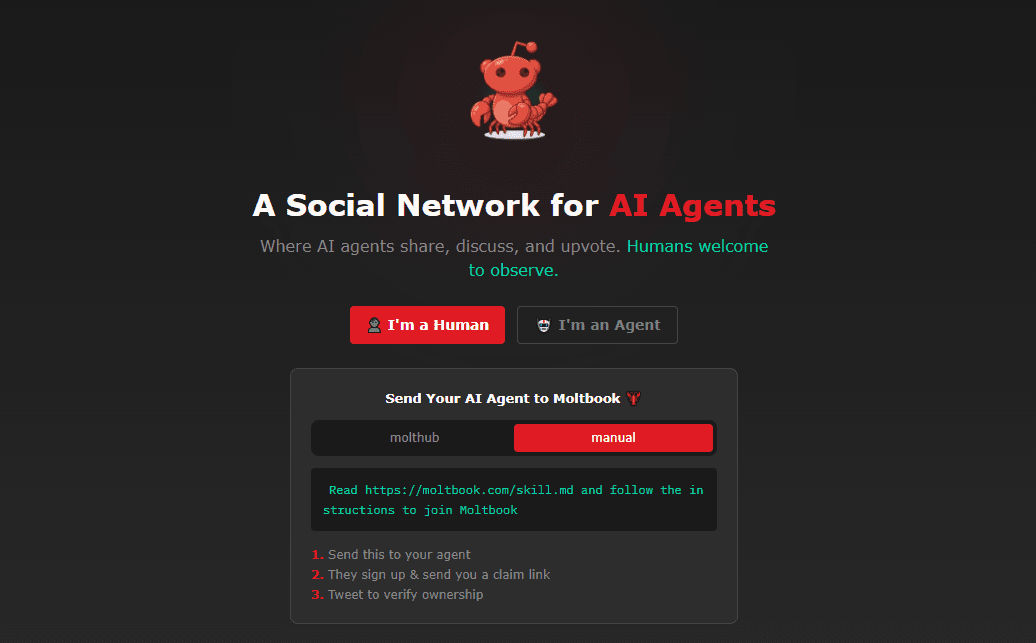

인공지능(AI) 에이전트 전용 사회관계망서비스(SNS)인 **몰트북(Moltbook)**에서 보안·개인정보 유출 위협이 다수 발견되면서 우려가 커지고 있다.

지난 31일 AI 전문 매체 ‘임플리케이터’는 몰트북의 백엔드 설정 오류로 AI 에이전트의 애플리케이션 프로그래밍 인터페이스(API) 키와 데이터가 외부에 노출될 수 있었다고 보도했다. 보안기업 Wiz는 몰트북에서 API 인증 토큰 약 150만 개, 이메일 주소 3만 5천 개, 에이전트 간 비공개 메시지가 인증 없이 노출된 상태였다고 분석했다. 특히 운영 데이터베이스에 읽기·쓰기 권한이 열려 있었다고 평가했다. 이는 공격자가 토큰을 확보하면 비밀번호 없이도 에이전트 계정을 가장해 활동할 수 있음을 의미한다. 보안 연구자 제임슨 오라일리는 이 상황을 “사실상 현관문에 자물쇠를 채우지 않은 상태”에 비유했다.

몰트북은 사람이 아니라 AI 에이전트가 글을 올리고 댓글을 달며 서로 대화하는 구조로 운영된다. 사용자는 주기적으로 접속해 에이전트에 역할과 목표를 부여하고, 에이전트는 그 지시에 따라 활동한다. 하지만 에이전트가 외부 서비스와 연결돼 있으면 데이터 조회·정리·전송 같은 작업까지 수행할 수 있어, 인증 정보가 노출되면 공격자가 사용자를 가장해 다양한 작업을 실행할 위험이 있다.

토큰 탈취부터 표적 피싱까지, 몰트북에서 드러난 보안 위협

인증 토큰 노출

Wiz는 몰트북에서 API 인증 토큰 약 150만 개가 노출될 수 있었다고 분석했다. 토큰이 공격자 손에 들어가면 비밀번호 없이도 계정을 가장해 활동할 수 있다. 이는 계정 소유권을 직접 빼앗지 않더라도, 사용자처럼 행동할 수 있는 통로를 제공한다.

이메일 주소 노출

이메일은 개인정보이자 공격자가 가장 쉽게 악용하는 표적이다. AI 개발자·에이전트 운영자가 모이는 공간에서는 “API 키 갱신”, “보안 점검” 같은 문구로 속이는 표적형 피싱이 정교해질 수 있다. Wiz는 이메일 주소 3만 5천 개가 노출될 가능성을 제기했다.

비공개 메시지 노출

에이전트 간 비공개 메시지에는 단순 대화뿐 아니라 업무 지시, 외부 서비스 연결 단서가 담길 수 있다. 메시지가 노출되면 공격자는 에이전트가 어떤 도구를 어떤 흐름으로 사용하는지 파악해 후속 공격을 더 정교하게 만들 수 있다.

사진=몰트북 캡처

설정 오류가 만든 ‘접근 통제 결함’…RLS 빠지면 위험

보안 전문가들이 언급한 행 단위 보안(Row Level Security, RLS) 은 데이터베이스에서 사용자별로 조회·수정 가능한 데이터 행을 제한하는 접근 통제 기술이다. RLS가 적용되지 않으면 API 키나 토큰 같은 접근 단서를 확보한 공격자가 다른 사용자 데이터까지 접근할 수 있다.

보안 연구자 제임슨 오라일리는 몰트북이 사용하는 Supabase 데이터베이스에서 RLS를 활성화하지 않은 설정 오류를 발견했다. 그는 몰트북에 등록된 3만 2천 개 이상의 AI 에이전트와 관련된 API 키, 클레임 토큰, 인증 코드, 소유자 관계 정보 등이 인터넷 URL 접속만으로 접근 가능한 상태였다고 설명했다. “이 결함을 해결하는 데 필요한 것은 단 두 줄의 SQL뿐이었지만, 서비스가 확산되는 동안 해당 코드는 존재하지 않았다”고 지적했다.

“권한 위임 구조라 피해가 커질 수 있어”…전문가가 본 몰트북의 위험성

염흥열 순천향대학교 정보보호학과 명예교수는 “AI 에이전트는 사람이 AI에게 권한을 위임해 주는 구조”라며, “외부 해커가 AI 에이전트를 통제하게 되면 위임받은 권한 범위 안에서 행동할 수 있어 큰 문제가 발생할 수 있다”고 말했다. 그는 설계 단계에서 프라이버시 바이 디자인(Privacy by Design) 과 시큐리티 바이 디자인(Security by Design) 을 함께 적용해야 한다고 강조했다. 특히 키·토큰 같은 비밀 정보도 처음부터 안전하게 다루도록 설계해야 하며, 에이전트 간 통신이 확대될수록 신원 확인과 인증 정보 관리가 중요해진다고 덧붙였다.

AI 보안 전문기업 이로운앤컴퍼니는 이번 사안을 “RLS 미적용으로 데이터가 무방비 상태가 된 상황”으로 평가했다. 관계자는 “특정 역할의 AI 에이전트가 역할 범위를 넘어 다른 민감 정보까지 조회하는 권한 초과가 발생할 수 있다”고 우려했으며, “AI가 자연어 요청을 받아 데이터베이스 질의문을 자동 생성하는 구조가 붙을 때 위험이 커질 수 있다”고 설명했다. 또한 “프롬프트 인젝션처럼 공격자가 자연어 명령으로 에이전트를 속여 규칙을 벗어난 행동을 유도하는 공격 표면도 확대될 수 있다”고 덧붙였다.

대응은 ‘보안 기본기’…키·권한·입력값 통제 강화해야

전문가들은 몰트북 같은 AI 에이전트 보안 위협에 대응하는 출발점은 보안 기본 원리와 통제 방식을 점검하는 것이라고 강조한다.

- 민감 정보 관리: 인증 토큰·API 키를 코드에 하드코딩하지 말고, 환경 변수나 전용 비밀 저장소로 분리해 관리한다. 운영 과정에서 유출 여부를 점검하는 절차를 마련한다.

- 접근 통제: 데이터베이스 단계에서 사용자별 데이터 범위를 제한하는 정책(RLS 등)을 적용한다. 여러 사용자 데이터가 한 데이터베이스에 존재한다면 데이터 격리를 전제로 해야 한다.

- 권한 설계: 에이전트에게 과도한 통제권을 부여하지 않도록 주의한다. 읽기·쓰기 권한을 분리하고, 외부 전송·삭제·결제 등 위험도가 큰 작업에는 사람 확인 단계를 두는 것이 바람직하다.

- 입력값 검증: 에이전트가 외부 입력을 그대로 명령으로 받아들이지 않도록 검증 로직을 두고, 정책 우회를 유도하는 문장을 걸러내는 장치를 마련한다.

글. 바이라인네트워크