为什么我构建了个人 AI 助手并保持它小巧

发布: (2026年3月10日 GMT+8 09:44)

3 分钟阅读

原文: Dev.to

Source: Dev.to

概览

我喜欢个人 AI 助手的想法,但大多数助手都显得沉重。使用时,往往会出现太多干扰:庞大的系统提示、过多的 token 开销、难以信任的框架,以及在你的请求和实际执行之间的多层中间层。

这就是我构建 Atombot 的原因——一个受 OpenClaw 和 nanobot 启发的小型个人 AI 助手。我并不是想打造一个复杂的代理平台;我想要更简洁的东西,能够理解、修改并真正使用。

隐私同样重要。个人助理会处理我的个人数据,我不想把这些数据发送到机器之外。这使得本地 LLM 支持对我而言尤为关键。虽然本地模型可以运行更重的助理框架,但它们常因系统提示、指令、工具定义以及额外逻辑带来的开销而在大上下文窗口上表现不佳。这在基于 API 的 LLM 上还能接受,但对本地模型来说就糟糕得多。我希望有更轻量的方案,让本地部署感觉更实际,而不是令人沮丧。

核心特性

- 本地 LLM 支持,上手简单

- 小而易懂的代码库,便于修改

- 持久记忆,用于长期上下文

- 提醒和计划任务(一次性或循环)

- Telegram 集成,可以在终端之外与其聊天

示例用例

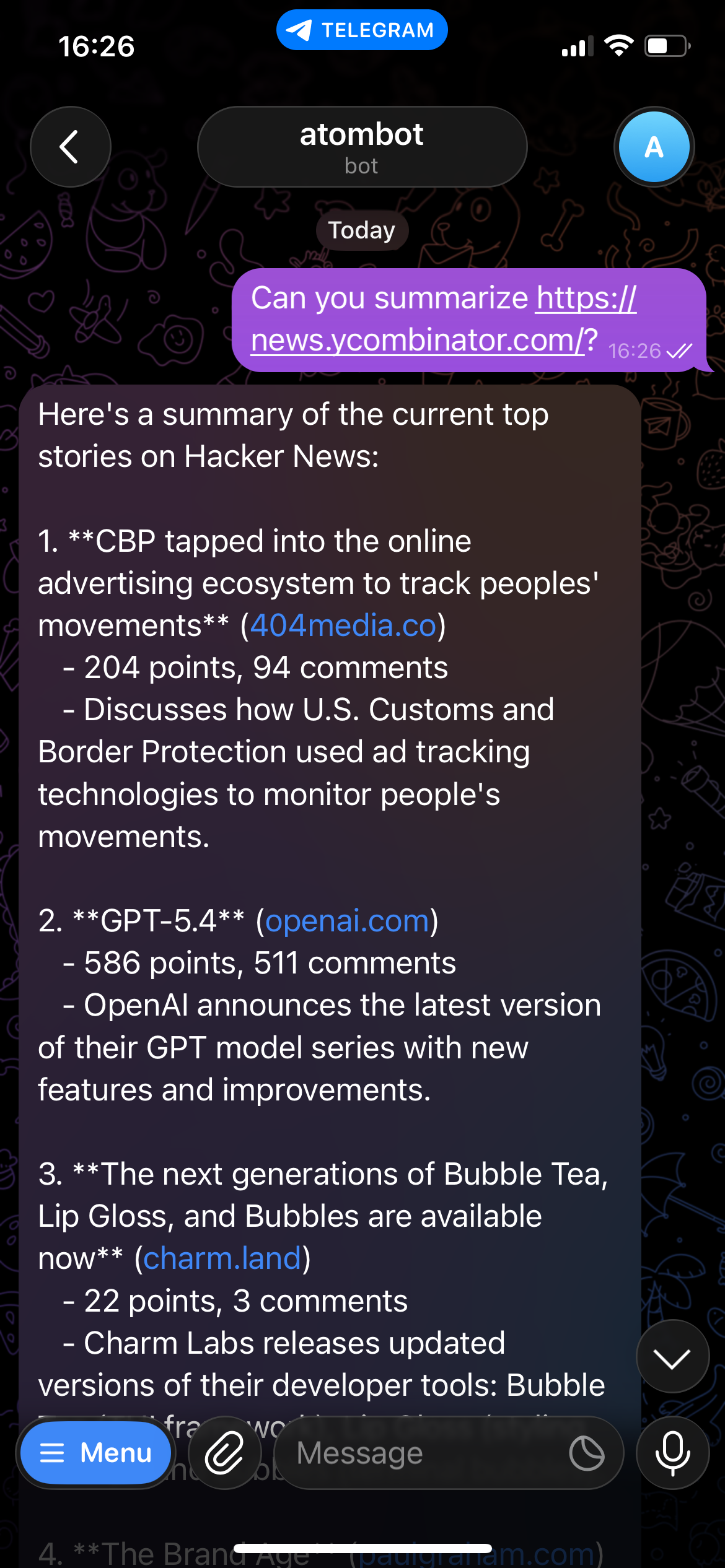

浏览网页并总结内容

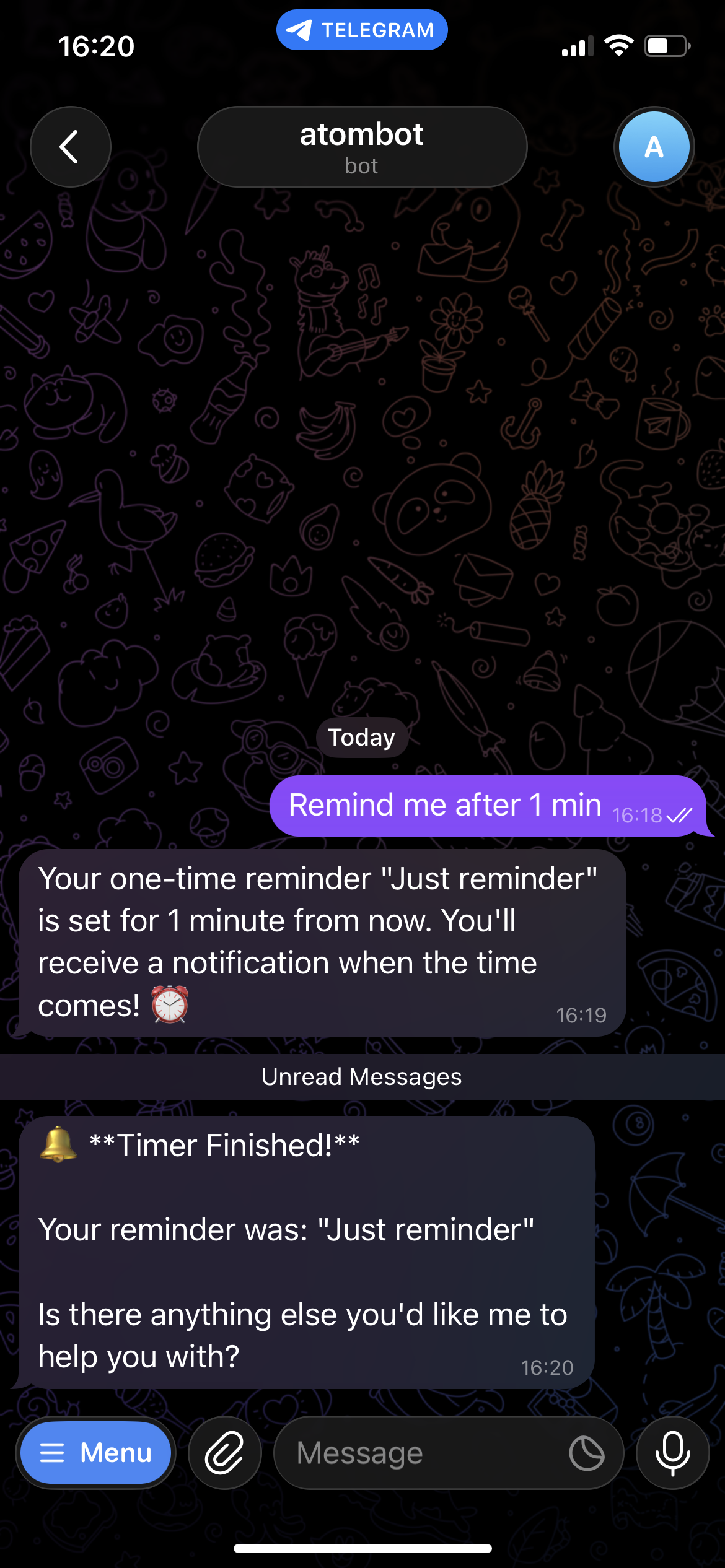

管理提醒

Atombot 可以浏览网站、总结发现的内容,并处理一次性或循环提醒。这只是两个示例,更多功能请查看仓库。

入门指南

如果你想尝试,前往 GitHub 查看项目:

https://github.com/daegwang/atombot

注:本文最初发布在我的站点 – 链接.