WAN模型在AI网关上

发布: (2026年2月19日 GMT+8 21:00)

4 分钟阅读

原文: Vercel Blog

Source: Vercel Blog

概览

通过 AI Gateway 使用阿里巴巴的 Wan 模型生成风格化视频并对现有素材进行改造。现在可通过 AI SDK 6 或在 AI Gateway Playground 中选择模型进行尝试。

Wan 能生成动作流畅的艺术视频,并可利用已有内容保持视频的一致性:

- 角色参考 (R2V) – 从参考视频/图片中提取角色外观和声音,以生成新场景

- 闪速变体 – 更快的生成时间,适合快速迭代

- 灵活分辨率 – 支持 480p、720p 和 1080p 输出

两种入门方式

AI SDK 6

使用 AI SDK 6 的 generateVideo 以编程方式生成视频。

import { experimental_generateVideo as generateVideo } from 'ai';

const { videos } = await generateVideo({

model: 'alibaba/wan-v2.6-t2v',

prompt: 'Watercolor painting of a koi pond coming to life.',

});Gateway Playground

在每个模型页面内嵌的可配置 AI Gateway Playground 中,无需编写代码即可试验视频模型。比较提供商、微调提示词并下载结果。只需在 模型列表 中点击任意视频生成模型即可访问。

可用模型

| 模型 | 类型 | 描述 |

|---|---|---|

alibaba/wan-v2.6-t2v | 文本到视频 | 根据文本提示生成视频 |

alibaba/wan-v2.6-i2v | 图像到视频 | 为静态图像添加动画 |

alibaba/wan-v2.6-i2v-flash | 图像到视频 | 快速图像动画 |

alibaba/wan-v2.6-r2v | 参考到视频 | 从参考素材进行角色迁移 |

alibaba/wan-v2.6-r2v-flash | 参考到视频 | 快速风格迁移 |

alibaba/wan-v2.5-t2v-preview | 文本到视频 | 之前的版本 |

简单:带音频的文本到视频

从文本描述生成风格化视频。示例使用 alibaba/wan-v2.6-t2v。

import { experimental_generateVideo as generateVideo } from 'ai';

const { videos } = await generateVideo({

model: 'alibaba/wan-v2.6-t2v',

prompt: `Animated rainy Tokyo street at night, anime style,

neon signs reflecting on wet pavement, people with umbrellas

walking past, red and blue lights glowing through the rain.`,

resolution: '1280x720',

duration: 5,

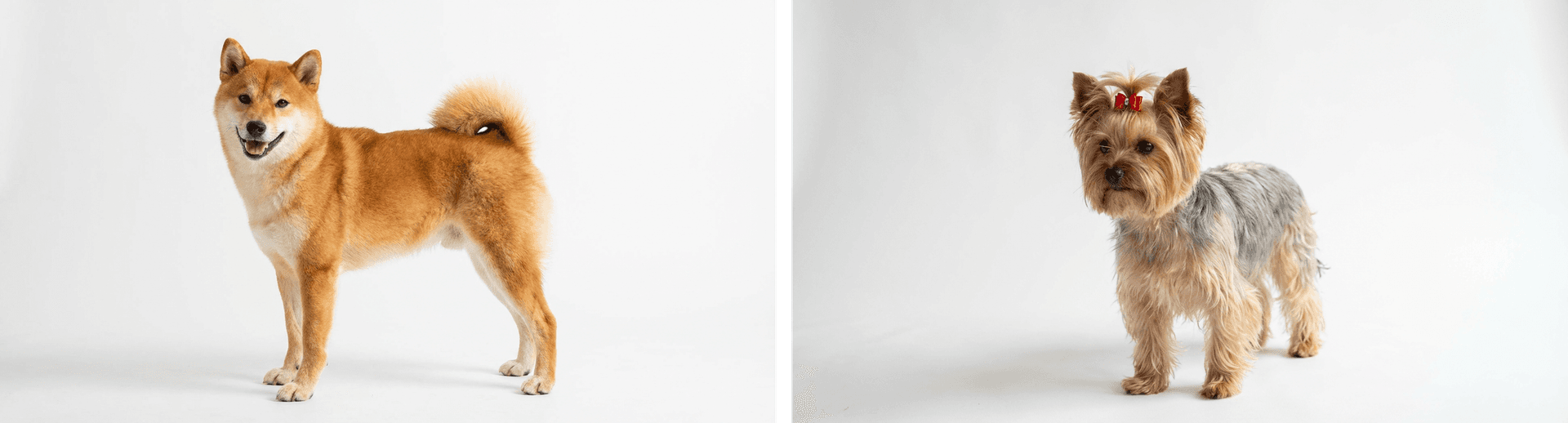

});高级:参考到视频

使用从参考图片或视频中提取的角色生成新场景。此示例使用两张狗的参考图片。

Wan 建议在多参考视频的提示词中使用 character1、character2 等,以获得最佳效果。

import { experimental_generateVideo as generateVideo } from 'ai';

const { videos } = await generateVideo({

model: 'alibaba/wan-v2.6-r2v-flash',

prompt: `character1 and character2 are playing together on the beach in San Francisco

with the Golden Gate Bridge in the background, sunny day, waves crashing`,

resolution: '1280x720',

duration: 5,

providerOptions: {

alibaba: {

referenceUrls: [shibaImage, yorkieImage],

},

},

});