将 AI 驱动的对话规模从 10K 扩展到 100K,同时保持实时一致性

Source: Salesforce Engineering

作者:Ashima Kochar 和 Deepak Mali.

Source: …

您团队在构建对话存储服务(Conversation Storage Service,CSS)时的使命是什么?它如何支持 Service Cloud 中的 AI 驱动客户互动?

CSS 不仅仅是一个存储系统——它是 对话上下文的唯一可信来源,直接为实时 AI 系统(如情感分析、座席辅助和主管洞察)提供动力。它提供 可扩展、可靠的基础,用于持久化和检索跨数字渠道的交互,并几乎实时可用。

负责 CSS 的团队构建了一个可扩展、可靠的对话数据基础,以在 Service Cloud 中实现 AI 驱动的互动。该平台持久化跨数字渠道的每一次交互,同时确保数据几乎立即可供下游系统使用。

随着有机数据的增长以及 Agentforce 和 CcaaS 的采用,工作负载必须支持高达 50 000 并发对话,峰值吞吐目标为 100 000。这些交互涉及更大的负载、更长的线程,以及对实时访问的更高期望。

这种规模是 统一代理通信平台(Unified Agentic Communication Platform,UACP) 的基础,使跨渠道和座席的对话保持一致、顺序的上下文。CSS 专注于高吞吐量的写入和低延迟的检索,以向 Data 360、Core 和 AI 流水线提供准确的数据,确保人工和 AI 代理都能基于完整、最新的交互视图进行操作。

当 CSS 扩展以支持分布式系统中的高并发对话工作负载时出现了哪些约束?

- CSS 在 10 000 并发对话 以上遇到瓶颈,因为基于 Postgres 的系统在高活跃租户的突发流量下表现不佳。这些流量激增导致热点并削弱了平台的写入性能。

- 为了解决此问题,团队转向 水平扩展的 No‑SQL DB,在租户层面对事件进行缓冲和批处理,以应对不断增长的摄入速率。

- 他们还引入了 Kafka 并基于会话级别分区,以更均匀地分配负载,在流量到达存储之前平滑峰值。

此转变仍有权衡:异步处理在写入与读取之间引入了延迟。这些写后读的间隙可能影响代理工作流,因此团队加入了 VegaCache,在持久化跟上之前直接提供最近的写入数据。

这些改动使 CSS 能够有效提升吞吐量。现在系统保持更快的写后读一致性,并为 AI 驱动的实时对话工作负载提供实时洞察。

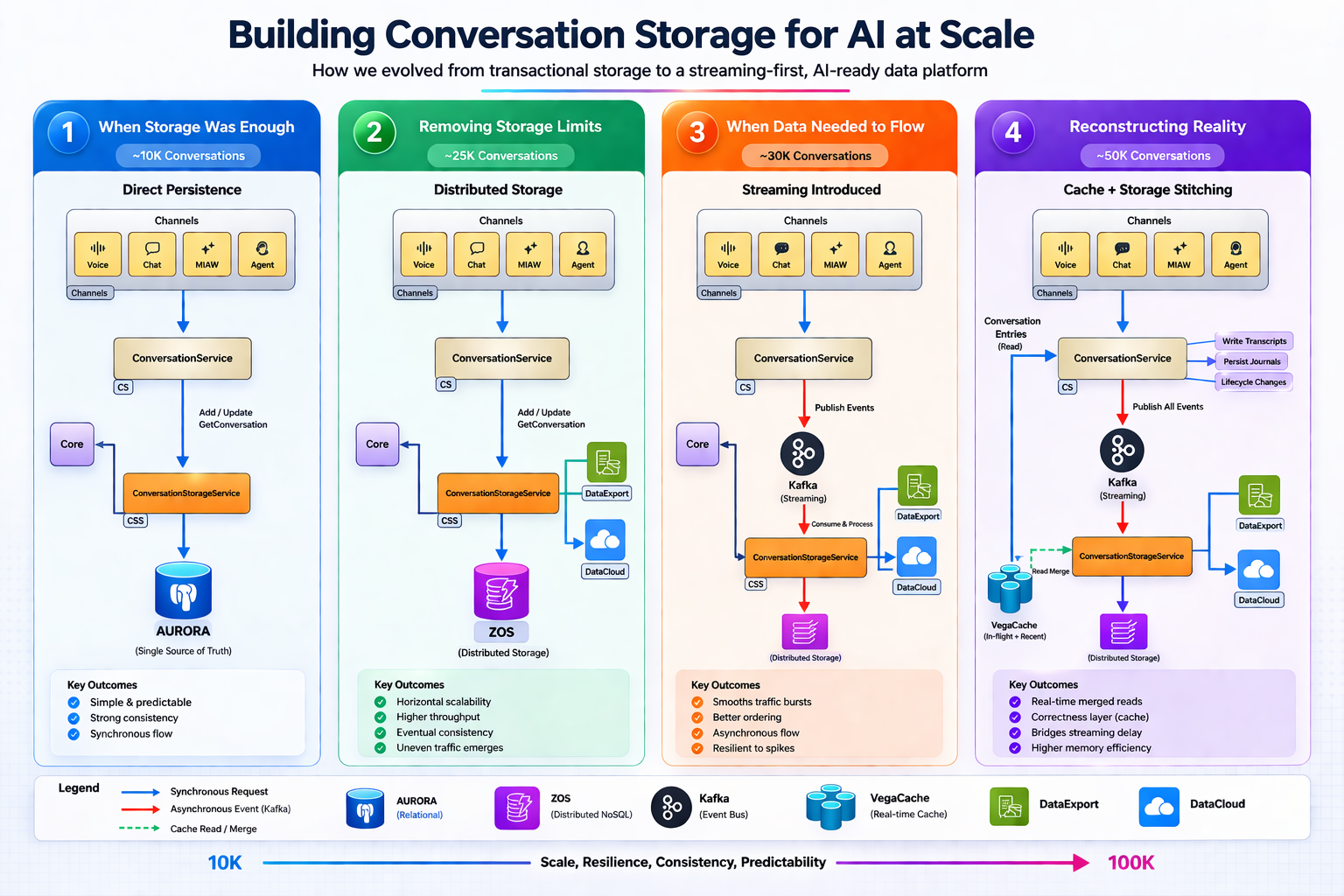

什么规模的压力塑造了 CSS 架构,从 1 万到 5 万,再到 10 万并发对话?

对话平台经历了架构演进,以实现 UACP 北极星和 CSS 目标。每个规模拐点都会暴露特定的限制,并推动后续的设计决策。

| 规模(并发) | 关键挑战 | 架构响应 |

|---|---|---|

| ~10 000 | 事务系统表现良好 | 基线设计 |

| ~25 000 | 流量不均——某些租户产生不成比例的负载 | 转向分布式存储 |

| ~30 000 | 需要稳定摄取 | 添加 Kafka 进行缓冲和批处理 |

| ~50 000 | 异步管道的延迟影响实时工作流 | 引入 VegaCache 实现写后读一致性 |

| ~100 000(目标) | 进一步的延迟和真相来源问题 | 正在转向 curated Kafka——将对话流转变为有序的真相来源,并减少对多个存储层的依赖 |

随着 AI 驱动的对话工作负载在数量、负载大小和实时性要求上增加,出现了哪些复杂性?

AI 驱动的对话工作负载显著提升了数据的量级和复杂度。现代交互现在包括:

- 更长的对话 和 更大的负载(例如,对话式电子邮件、语音转录、AI 生成的回复)。

- 对人类坐席和自动化系统的 近实时访问 需求,使得低延迟、持续一致的检索变得至关重要。

为了解决这些挑战,CSS 引入了多项数据效率和访问优化:

- 压缩 – 减少大负载的存储占用和网络带宽。

- 分页 – 将长对话分段获取,便于管理。

- VegaCache – 提供对最近更新的即时可见性,掩盖异步流式传输引入的延迟。

这些改进使 CSS 能够支持平台范围内 100 000 并发对话 的目标,确保 AI 驱动的坐席和人类用户都能基于完整、最新的交互视图进行操作。

Vice Cloud 现代化平台 (SCRT2) 组件

- CS 实现高吞吐量摄取。

- Ajna 稳定数据流。

- ZOS 扩展存储。

- VegaCache 保持实时可视性。

它们共同确保可预测的扩展性,同时不牺牲延迟或一致性。

在大规模摄取实时对话事件时,CSS 流式管道出现了哪些限制?

- 消费者延迟 成为主要挑战,一旦摄取速率超过 每分钟 30,000 条事件。

- 高负载导致事件进入队列,延迟数据持久化并产生信息访问的空白。

- 这些延迟可能会干扰需要即时数据的坐席任务和 AI 系统。

已采取的缓解措施

- VegaCache 立即提供最近的写入,掩盖流式延迟。

- 对话分区、批处理 和 背压控制 减少热点并稳定数据流。

这些更新帮助管道应对流量高峰,同时保持 AI 工作负载的一致性。作为 UACP 的一部分,此流式管道是 统一通信服务 (UCP) 的核心,能够将来自多个渠道的消息汇聚为单一的对话流,并在大规模下保持一致的摄取。

在确保 CSS 数据能够可靠地为下游系统(如 Data 360、核心报告和 AI 流水线)提供动力时,您遇到了哪些集成约束?

- 多样的下游格式 给模式映射和数据转换带来了困难。

- 为每种交互类型定义数据湖对象和数据模型对象,使集成变得缓慢且笨重。

解决方案

- 构建了一个 元数据驱动的集成层,简化新数据类型的添加并消除手动模式工作。

- CSS 还支持通过 S3 进行 批量导出,用于大规模分析。

这使 CSS 成为 数据分发层,而不仅仅是存储系统,能够同时服务于运营、分析和 AI 工作负载。

了解更多

- 保持联系 — 加入我们的 Talent Community!

- 查看我们的 Technology and Product 团队,了解如何参与。