OpenClaw 不仅在中国走红,还解决了结构性问题

看起来您只提供了来源链接,而没有贴出需要翻译的正文内容。请您把要翻译的文本(除代码块和 URL 之外)粘贴进来,我会按照要求把它翻译成简体中文并保持原有的格式。谢谢!

OpenClaw 在深圳发布

2023年3月6日,近千人排队等候在深圳腾讯总部外(source)。有的人携带 NAS 硬盘,有的人带着 MacBook,少数人则抱着 mini PC。他们在等待腾讯云工程师将一款名为 OpenClaw 的开源 AI 代理免费安装到他们的设备上。预约名额在一小时内被抢光。

OpenClaw 的工作原理

OpenClaw 在本地个人设备上运行,并通过 API 调用连接大型语言模型。它跨多个消息平台工作——包括 Slack、WhatsApp、Telegram 和飞书(类似 Slack 的中国企业沟通应用)——并自主执行多步骤任务:浏览网页、编写和调试代码、管理日历、发送电子邮件。

该项目由奥地利工程师 Peter Steinberger(X .com)构建,耗时约 100 天便成为 GitHub 历史上获星最多的仓库(GitHub)。中国媒体将其描述为已超越 Linux 的累计星数——这一里程碑是 Linux 用了超过 30 年才达到的。根据监测平台(Declawed.io)追踪的超过 142 000 个公开可见的 OpenClaw 代理,其中 近一半来源于中国。

国际媒体大多将其呈现为一种奇观。中国对 AI 的热情甚至超过硅谷。这种解读捕捉到了表面的热度,却忽视了其背后结构性的故事。

需求侧动态

采用速度反映了中国需求侧的特定力量。

- 在 小红书(中国版 Instagram)和 闲鱼(阿里巴巴的二手市场),付费安装服务几乎是一夜之间出现的,远程设置通常 $7 – $40,上门服务最高 $100。

- 教程视频在 抖音 和 哔哩哔哩 上铺天盖地,标题承诺在几分钟内掌握 AI。

- 与中国记者交谈的安装人员表示,他们的许多客户 没有明确的使用场景——他们先部署再后来想用途。

一个由中间商组成的 cottage industry——一些原来的电脑维修店——开始招聘程序员,以处理从深圳到成都等城市的超额需求。紧迫感更多是出于 不想落后,而不是生产力提升。

Supply‑side dynamics

更耐久的故事发生在供应侧。那些争相支持 OpenClaw 的公司并不仅仅是响应用户热情;它们在解决自身结构性问题。

The Doubao Phone episode

2025 年 12 月,字节跳动推出了 Doubao Phone Assistant,这是一款嵌入中兴手机的 AI 代理。该产品使用屏幕阅读技术代替用户操作应用——功能上与 OpenClaw 完全相同。

在 48 小时内,微信强制用户下线,淘宝触发验证码挑战,金融类应用标记安全风险。字节跳动撤退,关闭了微信相关功能,并公开呼吁“技术发展与行业接受之间的对齐”。(我在这里写到了该事件背后的结构性动态。)

OpenClaw’s opposite reception

三个月后,OpenClaw 以更丰富的功能集亮相。它全天候运行,每天调用模型 API 数百次,访问本地文件,并操作浏览器。中国技术界的响应与字节跳动的经历截然相反。

- 腾讯云、阿里云、百度云以及火山引擎(字节跳动自有云部门)都争相提供一键部署。

- 月光宝盒 AI 和 MiniMax 基于各自模型构建了托管版。

- 小米 宣布推出受 OpenClaw 设计启发的移动代理。

相同的野心,却得到相反的接待。中国 AI 堆栈的每一层都从 OpenClaw 中看到了收益——而这些收益之所以可能,正是因为 Doubao Phone 没有采用的架构选择。

Why the infrastructure push matters

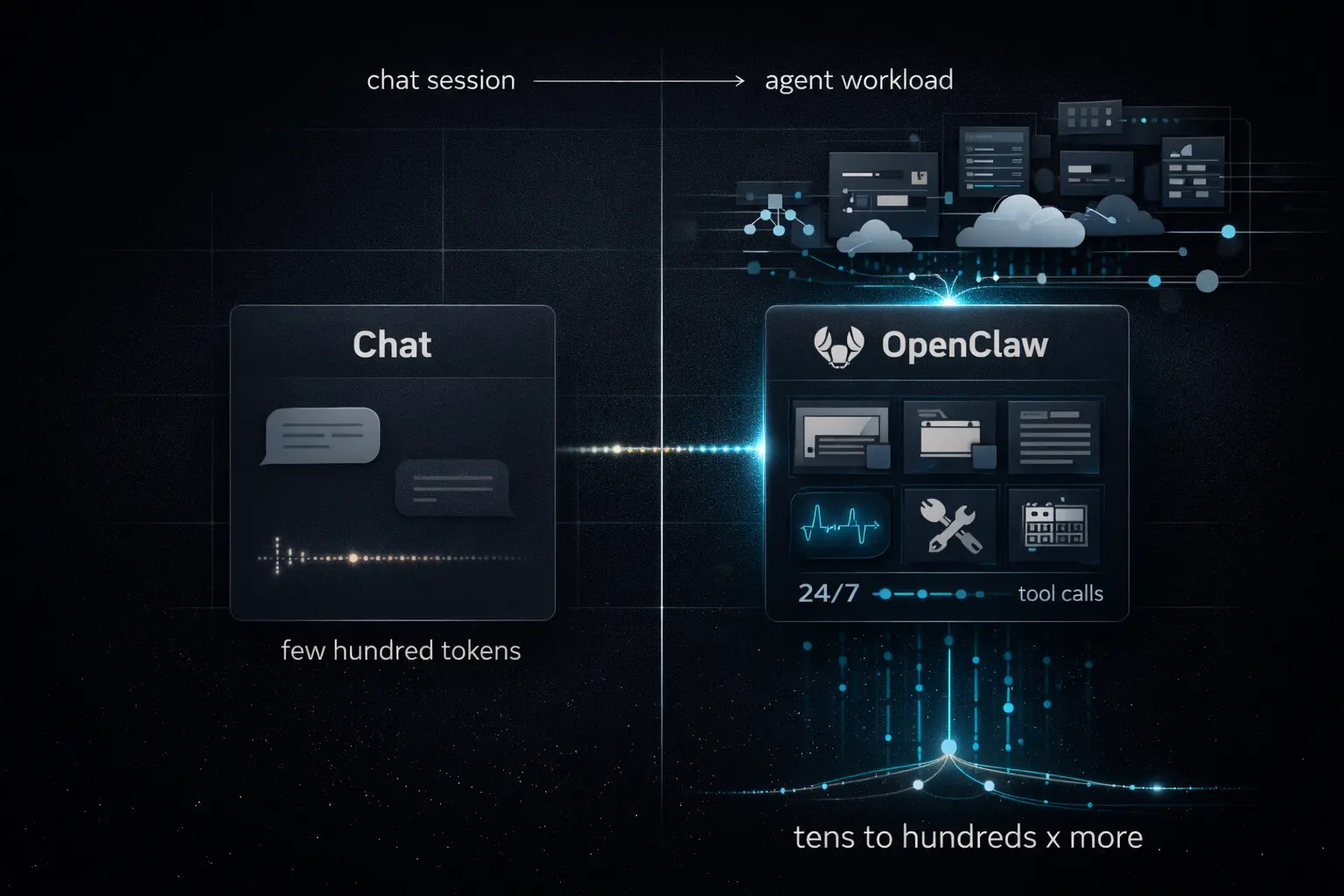

过去一年,中国主要科技公司在 AI 基础设施上投入巨大。字节跳动、阿里巴巴和腾讯的资本支出合计估计达 600 亿美元(来源)。如此规模的投入带来了寻找持续推理需求**的巨大压力。标准聊天机器人使用并未产生足够需求。一次典型的聊天会话每轮只消耗几百个 token——用户提问、得到答案、关闭应用。算下来根本不划算。

底线

- 需求方: 一波好奇心、FOMO(害怕错过)以及小作坊生态系统让 OpenClaw 成为一种文化现象。

- 供给方: 大规模 AI 基础设施投资迫使中国科技巨头寻找高频率、高价值的推理工作负载。OpenClaw 能在本地运行、重复调用 API 并与现有企业工具集成,使其成为生成这些工作负载的完美载体。

成千上万的人在腾讯门前排队的景象掩盖了更深层次的结构性转变:OpenClaw 不仅仅是新奇玩意儿;它是一个需求创造引擎,契合了中国最大科技公司在 AI 基础设施上的巨额押注。

**OpenClaw resets the consumption math.** A single configured instance with active tools can burn through **tens to hundreds of times more tokens per day** than a chatbot user. According to a widely circulated account in the developer community, one overseas user reported spending **$20 daily on API calls** with minimal productive output, driven largely by background polling. That figure sits at the high end, but the directional point holds at any scale: **agent workloads consume far more inference than chat sessions.**

**Every installed OpenClaw instance becomes a round‑the‑clock source of API calls flowing to cloud and model providers.** That is why Tencent engineers were setting up folding tables in front of headquarters to help strangers install free software. The cost advantage of Chinese open‑source models made them natural fits for this consumption pattern. Lower API prices encourage more frequent calls, which flow directly into cloud‑vendor revenue. The incentive loop is self‑reinforcing: the cheaper the model, the more users run their agents, the more infrastructure gets sold.