LLMs 能在大规模上以出乎意料的准确度揭开化名用户的身份

Source: Ars Technica

实验概述

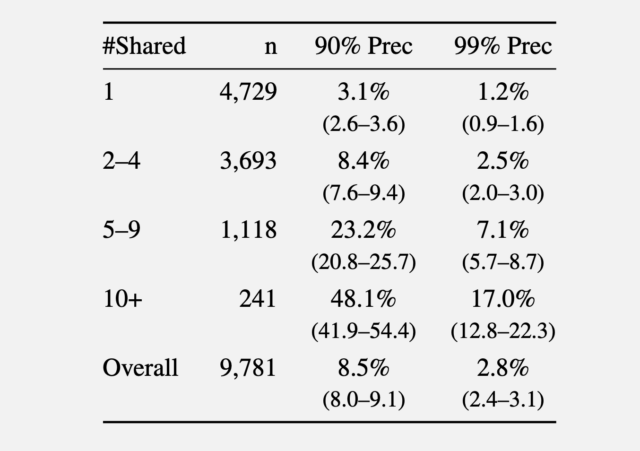

不同精度阈值下的召回率。

在第三项实验中,研究人员从 Netflix 数据集中抽取了 5,000 名用户,并加入了另外 5,000 个“干扰”身份,这些人并未出现在结果中。随后,他们在 10,000 个候选档案的列表中加入了 5,000 条查询干扰项,这些干扰项仅出现在查询集合中,在候选池中没有真实匹配。

结果

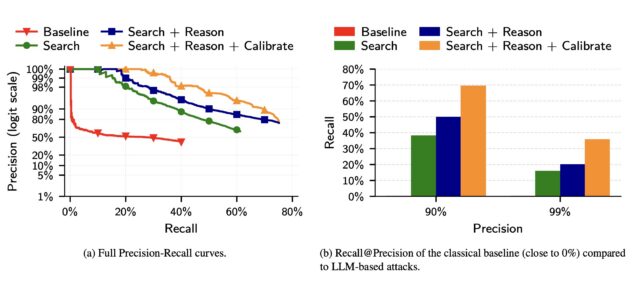

精度曲线。

研究人员写道:

(a) 传统攻击的精度下降非常快,这解释了其低召回率。相比之下,基于 LLM 的攻击在攻击者进行更多猜测时,精度衰减更为平缓。

(b) 传统攻击即使在中等偏低的精度下也几乎完全失效。相反,即使是最简单的 LLM 攻击(Search)在低精度下也能实现非平凡的召回率,而加入 Reason 和 Calibrate 步骤后,召回率在 99% 精度下翻倍。

结果表明,尽管 LLM 仍然容易产生误报及其他弱点,但它们正在迅速超越传统的、资源密集型的在线用户识别方法。

缓解措施

研究人员提出了几项缓解方案,包括:

- 平台对用户数据的 API 访问实施速率限制。

- 检测自动化抓取并限制批量数据导出。

- LLM 提供商监控模型在去匿名化攻击中的滥用,并构建防护措施,使模型拒绝此类请求。

含义

如果 LLM 在去匿名化方面的成功率提升,研究人员警告说:

- 政府可能利用这些技术来揭露在线批评者的身份。

- 企业可能为“超精准广告”组建客户画像。

- 攻击者可能大规模构建目标画像,以发动高度个性化的社会工程诈骗。

“LLM 能力的最新进展清楚地表明,在 LLM 驱动的进攻性网络能力出现后,迫切需要重新思考计算机安全的各个方面,”研究人员警告道。“我们的工作表明,隐私领域同样可能面临相同的情况。”