Google 最新的 Tensor 处理器走上环保路线,但成本如何?

Source: Android Authority

C. Scott Brown / Android Authority

TL;DR

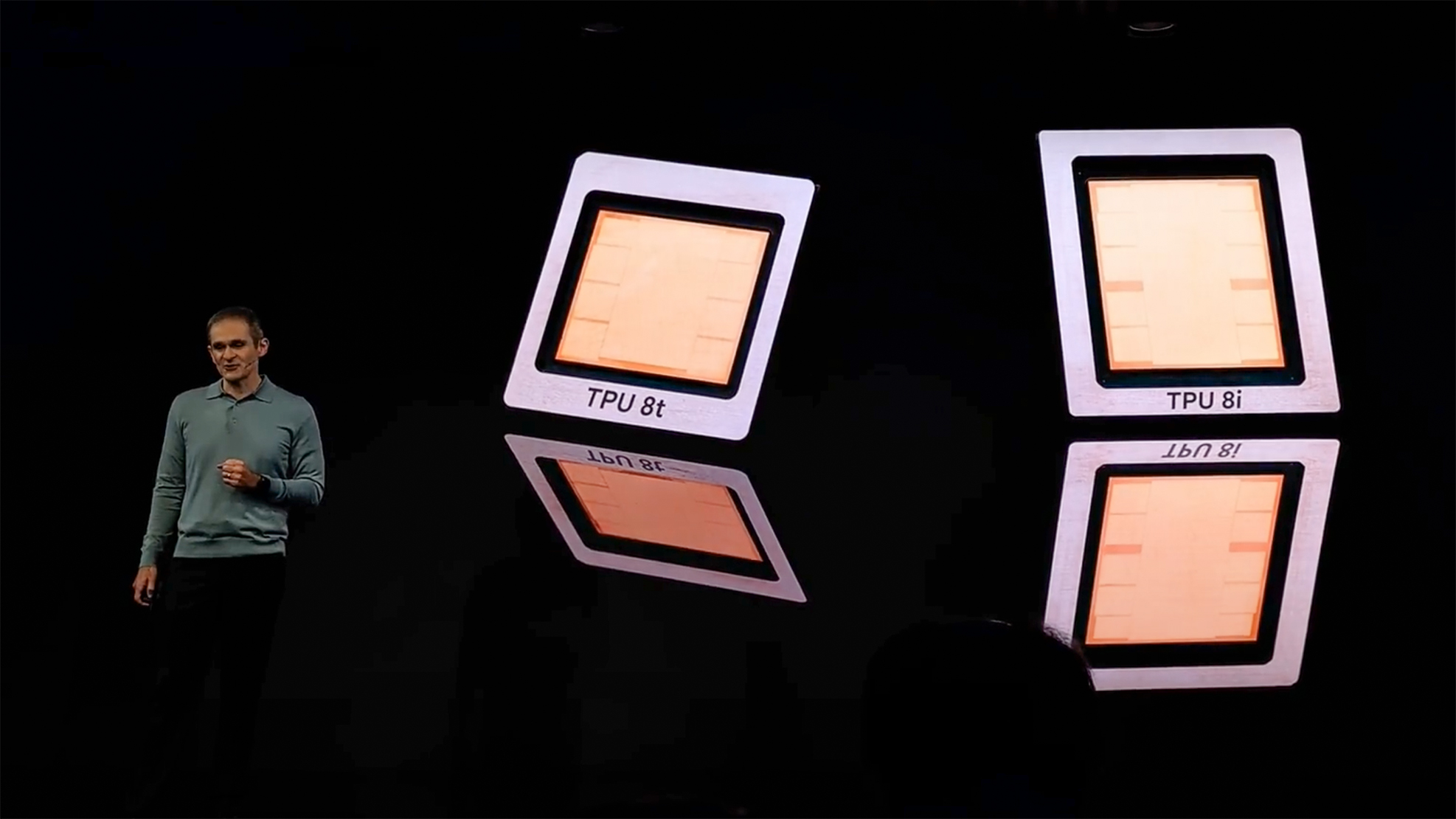

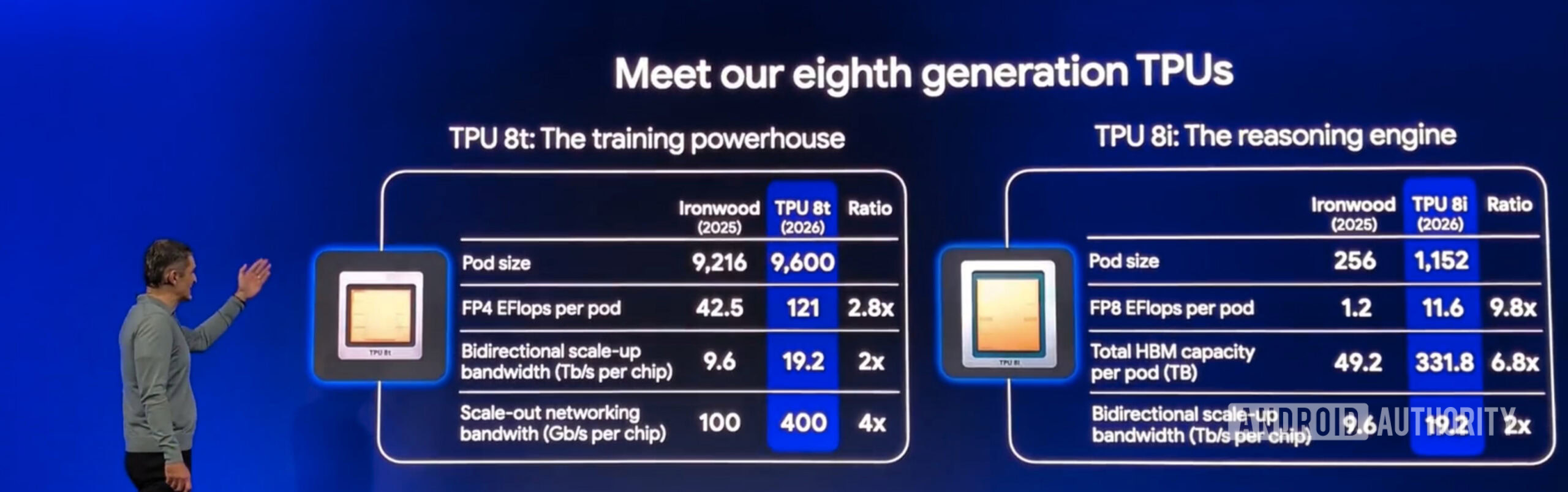

- Google 宣布了第八代用于其数据中心的张量处理单元(TPU)。

- 新的 TPU 按使用场景划分:训练专用单元和推理专用单元。

- Google 表示这将降低终端使用的能源需求,有助于环境保护。

新的第八代 TPU

在 Cloud Next 2026 上,Google 推出了两款新 TPU 型号:

| Model | Primary purpose |

|---|---|

| TPU 8t | 训练 AI 模型 |

| TPU 8i | 推理(运行已训练的模型) |

这种拆分架构旨在匹配训练与推理在功耗和计算需求上的差异,使数据中心能够降低能耗、削减运营成本,并减少 AI 对环境的影响。这可能意味着使用 Gemini 等服务时所需的冷却用水会更少。

训练 vs. 推理

训练

训练神经网络需要高带宽内存和大量处理单元集群,因为每秒会更新数十亿个参数。该过程依赖 误差的反向传播——一系列反馈回路,迭代地调整网络直至产生准确结果。

了解更多关于反向传播的内容。

C. Scott Brown / Android Authority

推理

推理的强度较低:它可以在性能较弱的硬件上运行,且内存消耗大幅降低。使用同一套硬件同时进行训练和推理会导致成本上升,尤其是针对推理任务时。

与之前 TPU 的比较

- TPU v5e – 之前推出的面向小规模运营的型号,“e”代表高效。

- TPU 8i – 看起来是 v5e 设计的大规模改进版,专为推理优化。

- 竞争对手 AWS Inferentia 也在推动训练与推理工作负载的分离。

成本与环境影响

Google 强调专用推理 TPU 的环保优势,但尚未对客户的成本降低作出明确承诺。目前尚不清楚这些效率提升是会转嫁给用户,还是作为公司利润保留。