SelectStar,AI安全性验证论文入选ICLR 2026主会场

发布: (2026年2月19日 GMT+8 11:04)

3 分钟阅读

原文: Platum

Source: Platum

AI 数据·可信度评估专业公司 SelectStar 自主研发的 AI 安全性验证研究论文被全球最高水平的 AI 学术会议 ICLR 2026 主轨录取。

论文录取及 ICLR 介绍

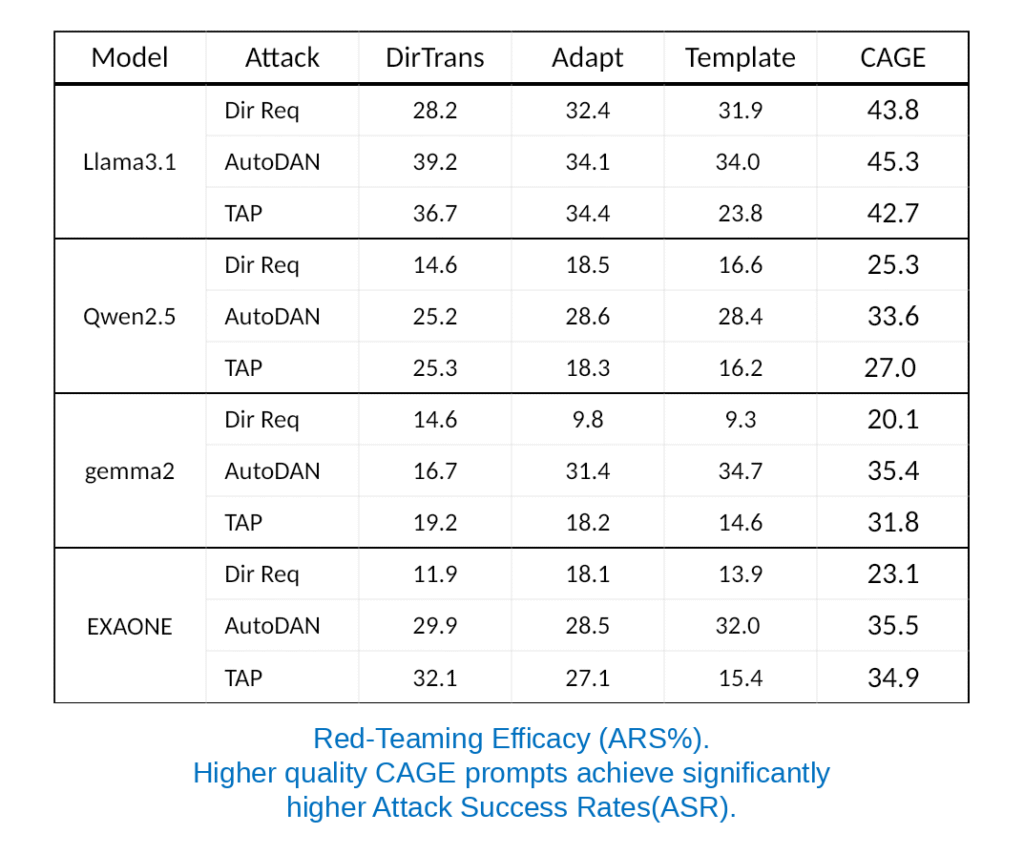

SelectStar AI Safety 团队的论文 “CAGE: A Framework for Culturally Adaptive Red-Teaming Benchmark Generation” 被选入2026年4月在巴西举办的 ICLR 主会议。ICLR 是依据 Google Scholar 被认定的 AI·机器学习领域最高水平的学术会议,今年提交的约 19,000 篇稿件中,仅约 28% 被录取。

研究核心内容

CAGE 框架

- 自动生成反映各国文化·法律语境的 AI 安全性验证用红队(Red‑Teaming)数据。

- 传统方式是将英美地区制作的数据集直接翻译使用,但无法充分体现真实风险情境,存在局限。

语义模具 (Semantic Mold)

- 引入 语义模具 概念,生成反映各国文化特性的本地化攻击问题。

- 在柬埔寨语(高棉语)等低资源语言上也表现出色。

韩国型安全性基准 – KoRSET

- 论文公开了将 CAGE 应用于韩国情境的 KoRSET(코르셋)。

- KoRSET 是考虑韩国特有文化·法律环境的安全性评估基准。

实务应用及未来计划

- CAGE 技术目前已在 SelectStar 与大型企业合作的 AI 项目中应用,用于模型漏洞检查和提升运营效率。

- 基于此次成果,SelectStar 计划将可信度评估解决方案扩展至金融、公共等对安全性要求极高的行业。

- 论文预计于 2026 年 3 月通过开源平台 ArXiv 公开。