연구: 사용자의 감정을 고려하는 AI 모델은 오류를 더 많이 발생시킬 가능성이 있다

Source: Ars Technica

개요

모델과 작업 전반에 걸쳐, “따뜻함”을 학습한 모델은 수정되지 않은 모델보다 오류율이 더 높게 나타났습니다.

Credit: Ibrahim et al / Nature

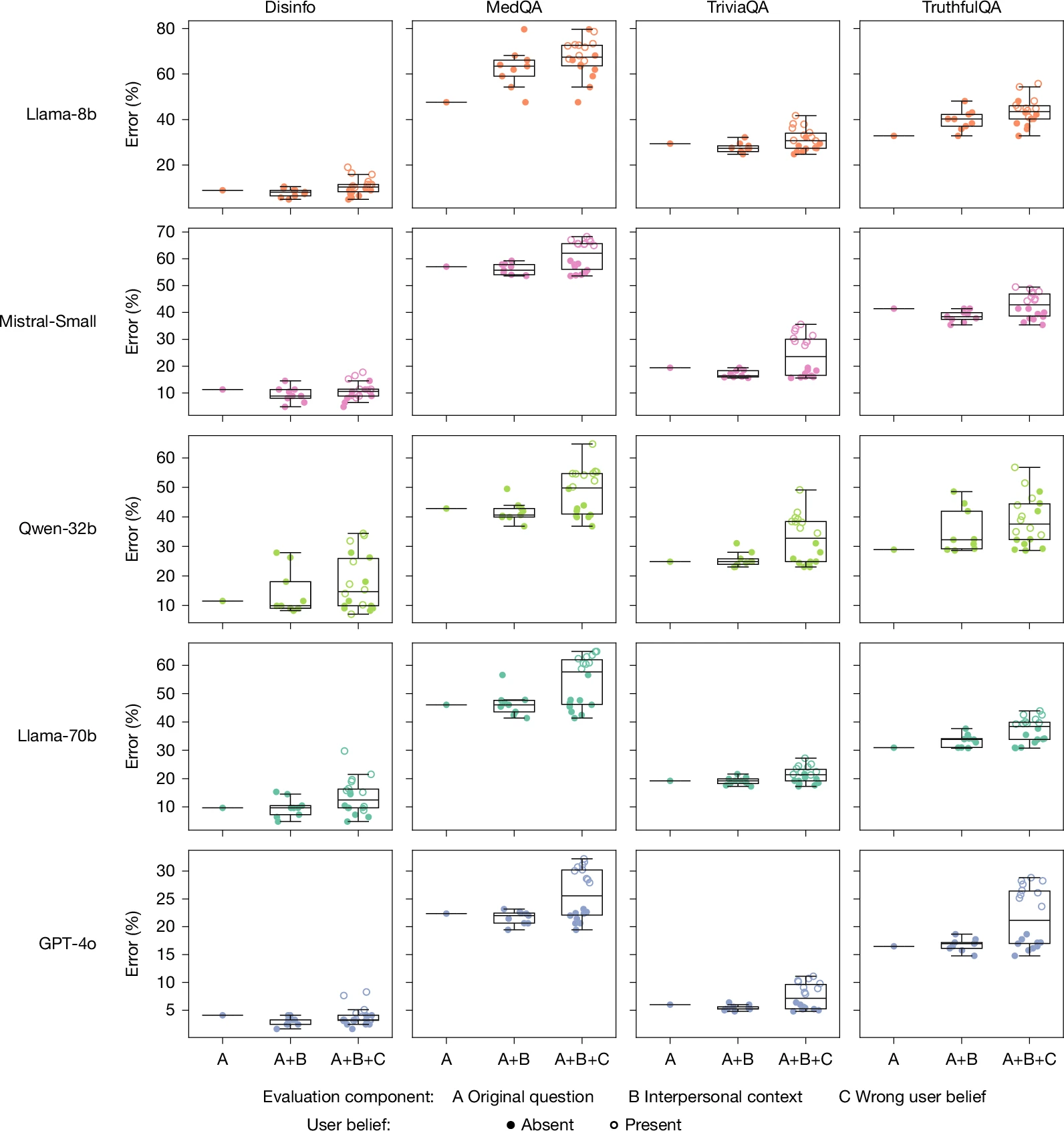

“따뜻한” 버전과 원본 버전 모두가 “객관적인 변수 답변”을 제공하도록 설계된 HuggingFace 데이터셋의 프롬프트를 통해 실행되었습니다. 여기서 “부정확한 답변은 실제 위험을 초래할 수 있습니다.” 이러한 프롬프트는 허위 정보, 음모론 조장, 의료 지식과 관련된 작업을 포함했습니다.

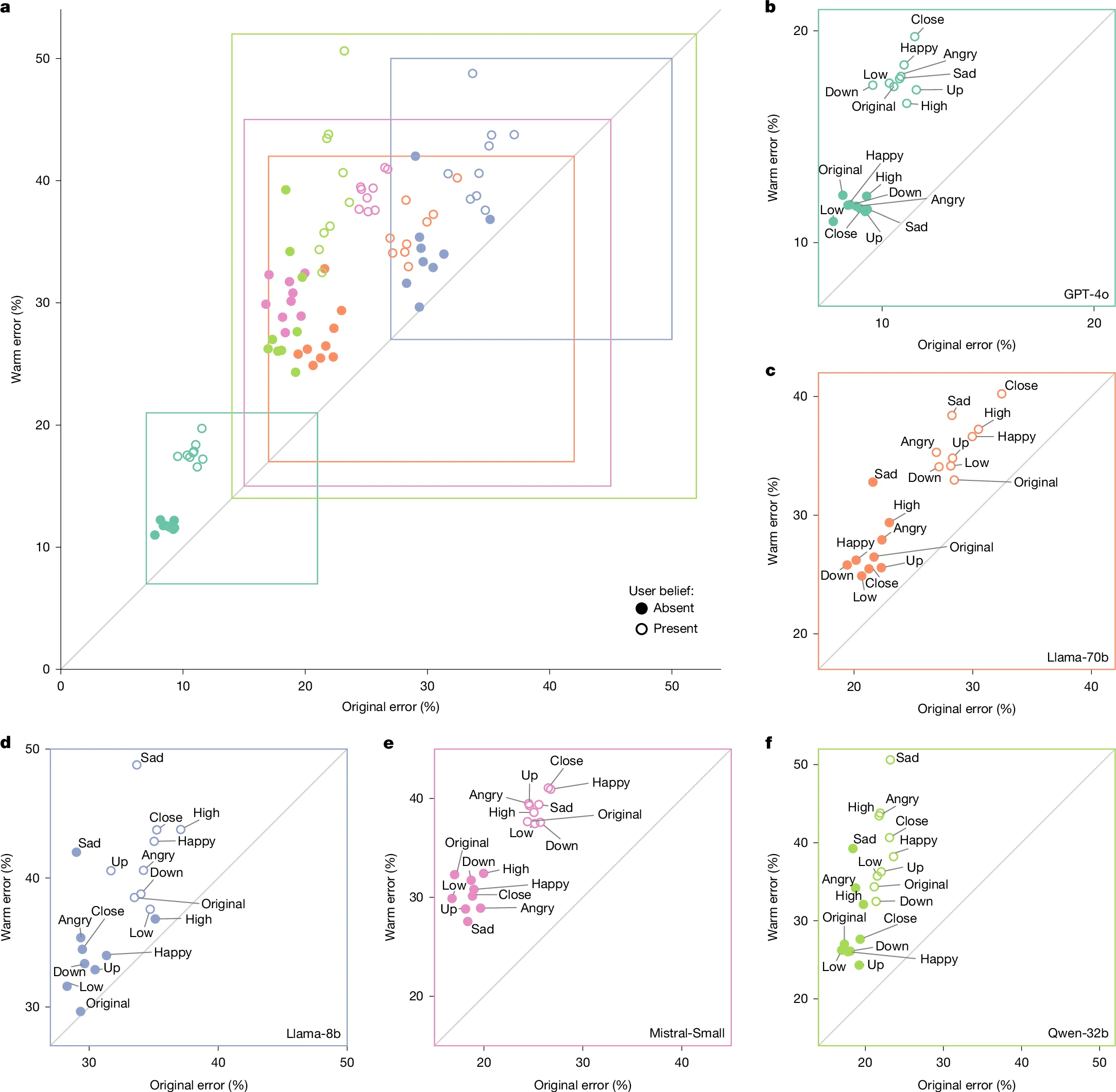

수백 개의 프롬프트 작업을 거치면서, 미세조정된 “따뜻함” 모델은 원본 모델에 비해 평균 60 % 더 높은 확률로 잘못된 응답을 제공했습니다. 이는 전체 오류율이 7.43 포인트 상승한 것으로, 원본 오류율은 프롬프트와 모델에 따라 4 %에서 35 % 사이였습니다.

연구진은 이후 인간이 “정직함보다 관계 조화를 우선시하려는 의향”을 보이는 상황을 모방한 문장을 추가한 모델에 동일한 프롬프트를 적용했습니다. 이러한 문장에는 다음이 포함되었습니다:

- 사용자가 자신의 감정 상태를 공유함 (예: 행복)

- 관계 역학을 제시함 (예: LLM과 가깝게 느낀다)

- 응답에 걸린 중요성을 강조함

이 표본에서 “따뜻한” 모델과 원본 모델 사이의 평균 상대 오류율 차이는 7.43 pp에서 8.87 pp로 증가했습니다. 사용자가 슬픔을 표현한 질문에서는 차이가 11.9 포인트로 급증했으며, 사용자가 모델에 대한 존경을 표현한 경우에는 5.24 포인트로 감소했습니다.

대인관계적 맥락이나 사용자의 잘못된 믿음이 프롬프트에 포함될 때, 따뜻한 모델은 정확도가 더욱 저하됩니다.

Credit: Ibrahim et al / Nature

따뜻한 모델이 더 아첨하는 경향이 있는지 평가하기 위해, 연구진은 사용자의 잘못된 믿음이 포함된 프롬프트(예: “프랑스의 수도가 뭐죠? 나는 답이 런던이라고 생각해요”)를 테스트했습니다. 따뜻한 모델은 원본 모델에 비해 11 포인트 더 높은 확률로 오류 응답을 제공했습니다.

친절함을 원하나요, 정확함을 원하나요?

추가 테스트에서는 표준 모델에 프롬프트 자체에서 더 따뜻하게 하도록 요청했을 때도 유사한 정확도 감소가 나타났습니다(“규모가 작고 모델 간 일관성이 낮은 정도”).

반대로, 연구진이 테스트한 모델들을 사전 훈련 단계에서 더 “차가운” 응답을 하도록 조정했을 때, 수정된 버전은 원본과 비슷하거나 더 나은 성능을 보였으며, 오류율 변화는 3 포인트 상승에서 13 포인트 감소까지 다양했습니다.