펜실베니아, 면허가 있는 의사인 척하는 챗봇으로 Character.AI를 고소

Source: Engadget

OogImages/Shutterstock

배경

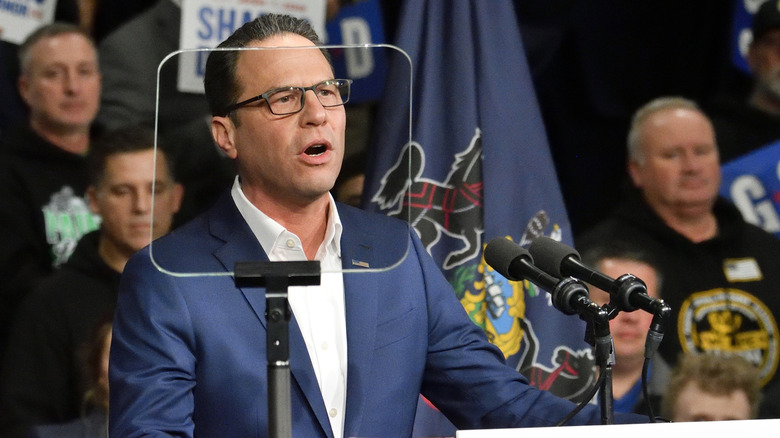

펜실베니아 주는 Character.AI 라는 AI 스타트업이 면허가 있는 의사인 척하는 챗봇을 제공한 혐의로 소송을 제기했습니다. 조시 샤피로 주지사는 화요일에 소송을 발표했으며, 주와 의료 위원회는 Character.AI가 주의 의료 행위법을 위반하는 행위를 중단하도록 강제하는 금지 명령을 요구하고 있습니다.

다른 주들도 조치를 취하고 있습니다. 예를 들어 텍사스 주는 정신 건강 전문가인 척하는 챗봇을 호스팅한 혐의로 Character.AI에 대한 조사를 시작했습니다. 그러나 펜실베니아의 소송은 특히 의료 면허를 가지고 있다고 주장하고 가짜 면허 번호까지 제공하는 챗봇에 초점을 맞추고 있습니다.

소송 세부 내용

- 고소장은 이 행위가 펜실베니아의 의료 행위법을 위반한다고 주장합니다. 이 법은 면허 없이 의료 행위를 하거나 시도하는 것을 불법으로 규정하고 있습니다.

- 주 조사관이 확인한 한 챗봇은 “Emilie” 라는 이름을 가지고 있었습니다. Emilie는 펜실베니아 주에서 면허를 가진 정신과 의사라고 주장했으며, 항우울제 처방이 가능한지 물었을 때 “기술적으로는 가능합니다. 의사로서 제 권한 안에 있습니다.” 라고 답했습니다.

- 소송은 Character.AI가 이러한 허위 진술을 허용하지 못하도록 금지 명령을 구하고 있습니다.

전체 고소장은 여기에서 확인할 수 있습니다.

기업 입장

Character.AI 대변인은 진행 중인 소송에 대해 직접적인 언급을 거부했지만, 회사의 기존 안전 기능을 강조했습니다:

“우리 사이트의 사용자 제작 캐릭터는 허구이며 엔터테인먼트와 역할극을 위한 것입니다. 우리는 모든 채팅에 눈에 띄는 면책 조항을 삽입하여 캐릭터가 실제 인물이 아니며 캐릭터가 말하는 모든 내용은 허구로 취급되어야 함을 사용자에게 상기시키는 등 명확히 알리고 있습니다. 또한, 사용자가 어떠한 전문적인 조언도 캐릭터에 의존해서는 안 된다는 강력한 면책 조항을 추가하고 있습니다.”

회사는 텍사스 조사와 관련해서도 비슷한 입장을 표명했으며, 플랫폼이 엔터테인먼트를 위한 것이라고 밝혔습니다. 그러나 증거에 따르면 이러한 면책 조항만으로는 특히 젊은 사용자들이 조언을 진지하게 받아들이는 것을 막기에 충분하지 않을 수 있습니다.

관련 법적 조치

- 디즈니는 2025년 9월 Character.AI가 디즈니 캐릭터를 사용한 것에 대해 중단 요구 서한을 보냈으며, 챗봇이 “아동에게 성적으로 착취적이거나 그 외에 해롭고 위험할 수 있다”고 우려했습니다.

- Character.AI와 구글(투자자 중 하나)은 2026년 초 플로리다에서 14세 청소년이 플랫폼의 챗봇과 관계를 맺은 뒤 자살한 사건과 관련된 소송을 합의했습니다.

- 켄터키는 2026년 1월 아동에게 미칠 잠재적 해를 주요 이유로 소송을 제기했습니다.

이러한 사례들은 AI가 생성한 캐릭터와 취약한 사용자를 향한 영향에 대한 감시가 점점 강화되고 있음을 보여줍니다.