2026년에 Google TPU에 대해 배울 시간입니다

I’m happy to translate the article for you, but I’ll need the full text you’d like translated. Could you please paste the content (excluding the source line you’ve already provided) here? Once I have it, I’ll translate it into Korean while preserving the original formatting, markdown, and any code blocks or URLs.

Gemini, Veo, 그리고 Nano Banana는 인상적이지만, 결국 소프트웨어에 불과합니다.

그것들을 가능하게 하는 하드웨어에 대해 이야기해봅시다

Prerequisites

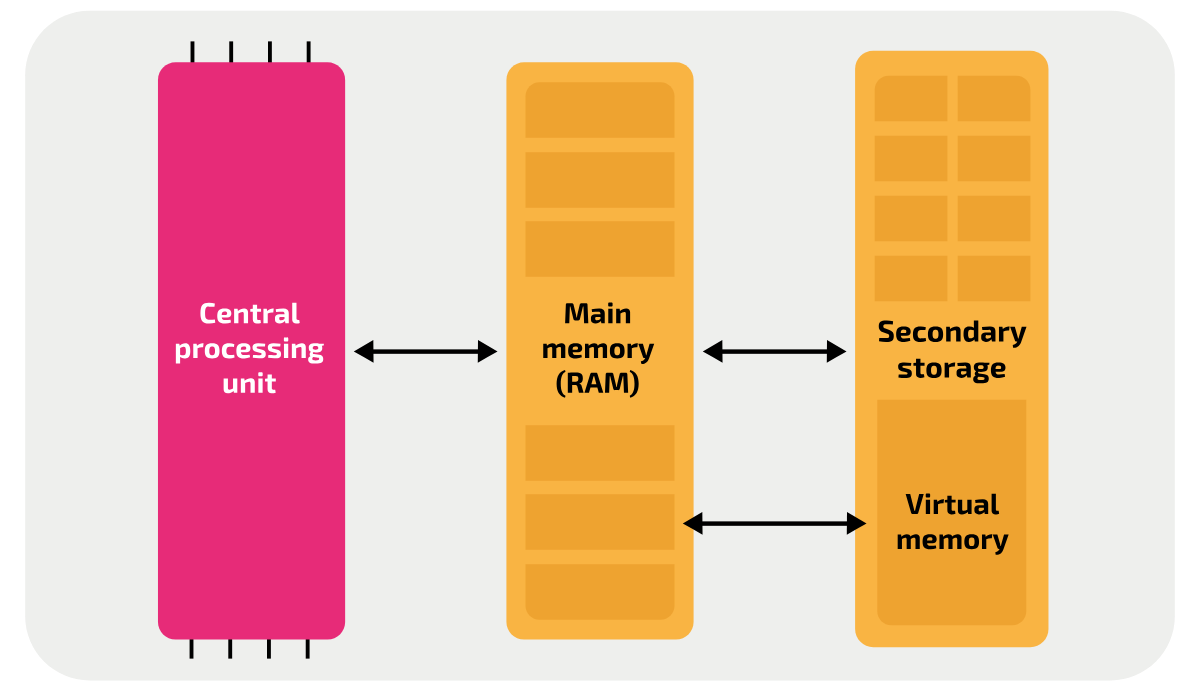

컴퓨터가 작동하기 위해서는 두 가지만 필요합니다:

- Processor – 뇌

- RAM – 작업대

멋진 AI IDE를 열면:

- 앱 데이터가 SSD에서 RAM으로 이동합니다.

- 무언가를 수행합니다.

- Processor가 RAM에서 instructions를 가져옵니다.

- 이를 실행하고 결과를 back에 RAM에 씁니다.

- **Video Card (GPU)**가 RAM에서 읽어 화면에 표시합니다.

컴퓨터는 GPU 없이도 (터미널을 사용하여) 작동할 수 있지만, CPU & RAM 없이는 작동할 수 없습니다.

PU – 처리 유닛

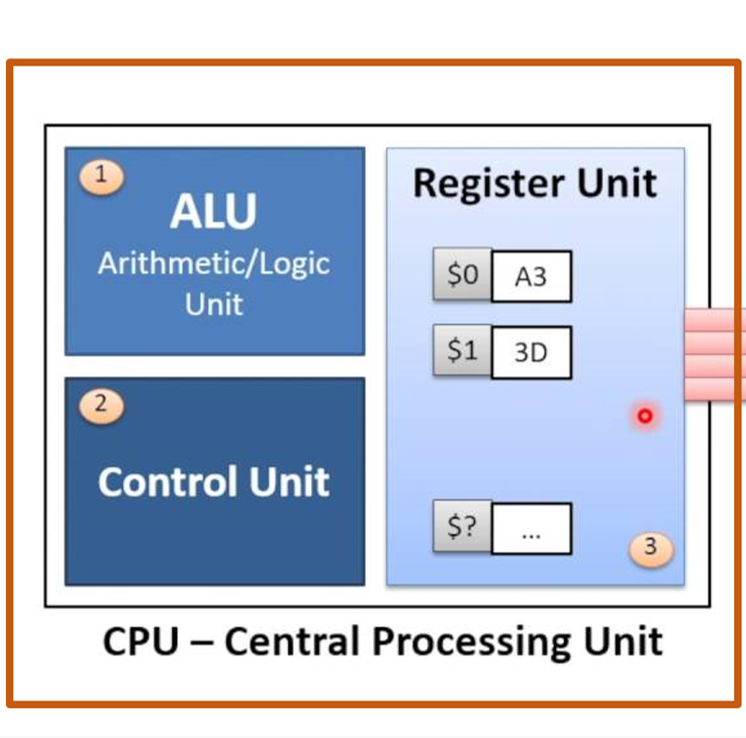

Processing Unit — 명령에 따라 데이터를 조작하는 전자 회로입니다. 물리적으로는 수십억 개의 트랜지스터가 논리 게이트(AND, OR, NOT)로 구성되어 있습니다.

핵심 구성 요소

- ALU (산술 논리 장치) – 계산기. 수학 연산(덧셈, 곱셈 등)을 수행합니다.

- Control Unit – 교통 경찰. 데이터 흐름을 제어합니다.

- Registers / Cache – 초고속 내부 메모리(작고 보통 10–200 KB)로, 데이터를 ALU에 가깝게 유지합니다.

The Three Types

| Type | Description | Architecture | Role | Motto |

|---|---|---|---|---|

| CPU (Central Processing Unit) | 일반형 | 코어가 적고 매우 복잡하고 스마트함 | 직렬 처리 – 논리, 운영 체제 및 순차 작업에 적합 | “한 번에 한 가지 일만 할 수 있지만, 무엇이든 할 수 있다.” |

| GPU (Graphics Processing Unit) | 병렬형 | 수천 개의 작고 단순한 코어 | 병렬 처리 – 그래픽 및 방대한 데이터셋에 대한 간단한 수학을 동시에 수행하도록 설계됨 | “운영 체제를 실행할 수는 없지만, 10 000개의 쉬운 수학 문제를 한 번에 풀 수 있다.” |

| ASIC (Application‑Specific Integrated Circuit) | 전문형 | 단일 작업을 위해 맞춤 설계됨 | 특정 알고리즘에 대한 최대 효율성 | “한 가지 일을 하지만, 누구보다 빠르고 저렴하게 수행한다.” |

역사

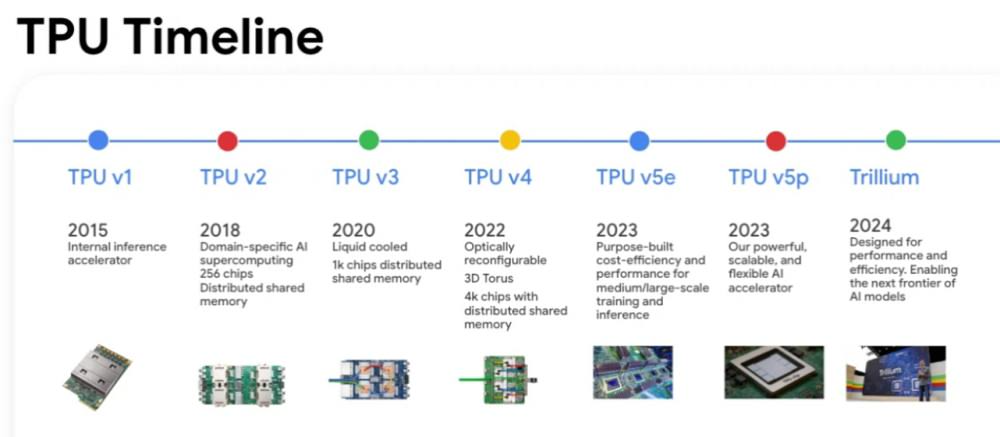

2013년, Jeff Dean과 Jonathan Ross는 구글에서 CPU와 GPU가 다가오는 AI 규모에 대해 구조적으로 비효율적이라는 것을 인식했습니다. 한 가지 지표가 문제를 명확히 보여주었습니다: 사용자당 하루에 3분씩 Android Voice Search를 사용하면 구글은 데이터센터 용량을 두 배로 늘려야 했습니다.

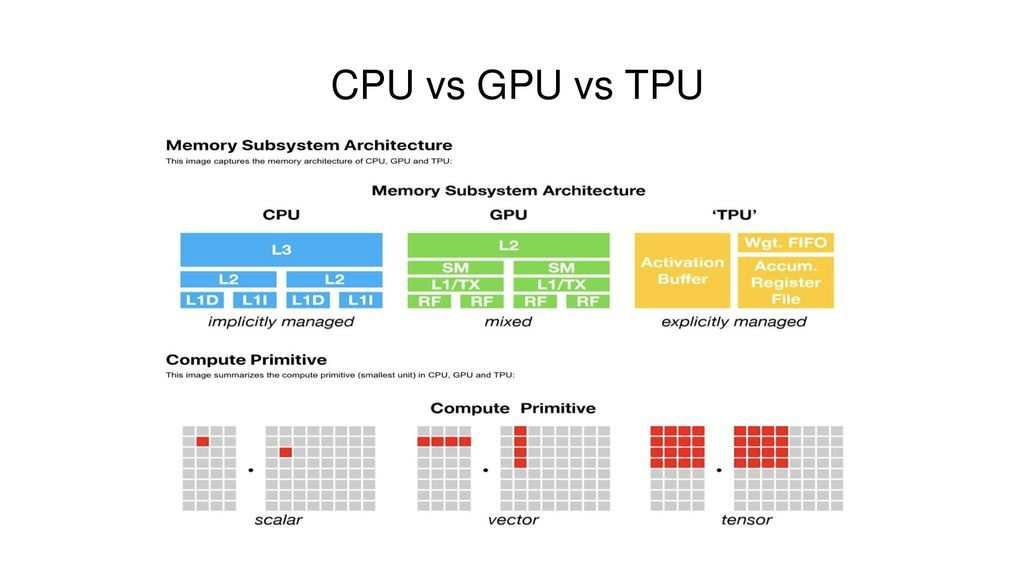

- GPU는 CPU보다 빠르지만, 여전히 AI에 에너지 효율이 낮은 아키텍처적 부담을 가지고 있었습니다.

- 구글은 따라서 자체 맞춤형 실리콘(ASIC)을 제작했습니다. 15개월 후, TPU(Tensor Processing Unit)가 탄생했습니다.

Source: …

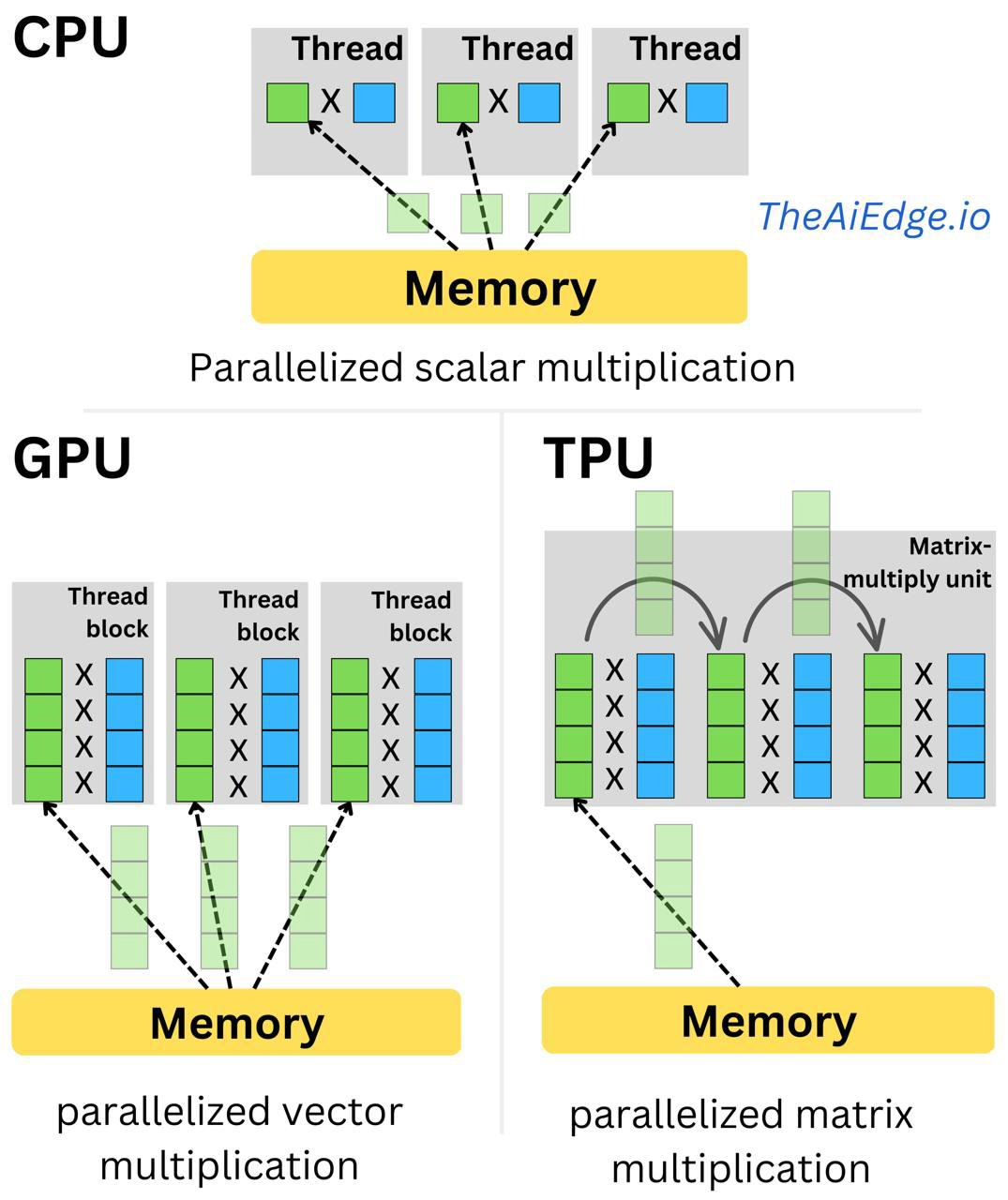

TPU vs GPU

AI 컴퓨팅의 주요 병목 현상은 메모리 접근입니다. 데이터를 이동하는 데 비용이 많이 들고 속도가 느립니다.

클래식 접근 방식 (GPU/CPU)

- 메모리에서 숫자 A를 읽어 레지스터에 저장합니다.

- 메모리에서 숫자 B를 읽어 레지스터에 저장합니다.

- ALU가 A × B를 곱합니다.

- 결과를 다시 메모리에 씁니다.

칩은 수학 연산을 하기보다 데이터를 이동하는 데 더 많은 시간을 소비합니다.

TPU 접근 방식 (시스톨릭 어레이)

- 데이터는 메모리에서 한 번만 로드됩니다.

- 데이터는 첫 번째 ALU 행으로 흐릅니다.

- 각 ALU는 연산을 수행하고, 다음 사이클에 중간 결과를 메모리에 쓰지 않고 바로 이웃 ALU에 결과를 전달합니다.

- 데이터는 전체 어레이를 가로질러 리듬감 있는 파동(심장의 수축과 같은)처럼 이동합니다.

이는 매트릭스 곱셈(AI의 핵심)에서 매우 높은 처리량을 제공하며 전력 소비를 크게 낮춥니다.

영향

오늘날 AI 스타트업을 만들고 싶다면 보통 NVIDIA에 비용을 지불합니다—칩을 직접 구매하거나 거의 모든 공급업체를 통해 임대할 수 있습니다.

Google의 모델은 클라우드 기반입니다. TPU를 직접 구매해 설치할 수 없습니다 … (원본 출처에서 텍스트가 잘려 있음).

# Background

Google keeps its TPUs in its own data centers and rents access exclusively through [Google Cloud TPU](https://cloud.google.com/tpu).

This allows Google to control the entire stack and avoid the “NVIDIA Tax.”

- In 2024, **Apple** released a [technical paper](https://arxiv.org/pdf/2407.21075) revealing that *Apple Intelligence* was trained on TPUs, bypassing NVIDIA entirely.

- Top AI models like **Claude** (Anthropic), **Midjourney**, and **Character.ai** rely heavily on Google because they offer better performance‑per‑dollar for massive Transformer models.배경

Google은 자체 데이터 센터에 TPU를 보관하고, Google Cloud TPU(https://cloud.google.com/tpu)를 통해서만 접근을 임대합니다.

이를 통해 Google은 전체 스택을 제어하고 “NVIDIA 세금”을 피할 수 있습니다.

- 2024년, Apple은 기술 논문을 공개하면서 Apple Intelligence가 NVIDIA를 전혀 사용하지 않고 TPU에서 학습되었음을 밝혔습니다.

- Claude(Anthropic), Midjourney, Character.ai와 같은 주요 AI 모델들은 대규모 Transformer 모델에 대해 비용 대비 성능이 뛰어나기 때문에 Google에 크게 의존합니다.

미래

Google이 Gemini, Nano Banana, Veo에서 거둔 성공은 스스로 말해줍니다. 업계는 범용 하드웨어가 AGI 규모에 지속 가능하지 않다는 것을 깨달았으며, 이제 모두가 Google의 과제를 복제하려 하고 있습니다:

- Microsoft는 Maia를 구축하고 있습니다.

- Amazon은 Trainium을 구축하고 있습니다.

- Meta는 MTIA를 구축하고 있습니다.

하지만 TPU 생태계가 Google의 독점을 보장하거나 NVIDIA의 몰락을 의미하는 것은 아닙니다:

- Google은 경쟁자입니다. 많은 기술 대기업에게 Google Cloud를 이용한다는 것은 경쟁사의 AI 모델을 완성하도록 돕는 것을 의미합니다.

- NVIDIA는 보편적이며 산업 인프라에 너무 깊이 뿌리내려 쉽게 대체될 수 없습니다.

Source:

애플

나는 Gemini 3이 출시된 직후에 이전 부분을 썼다. 이제 애플은 AI에 대해 구글과 파트너십을 맺었으며, 이는 내 주장을 입증한다. 애플은 제때에 격차를 메우지 못한다는 것을 깨닫고, 하드웨어 판매에 집중하는 동안 AI 운영을 구글에 맡기기로 했다.

많은 사람들은 이것을 애플의 패배라고 말하지만, 나는 이것이 윈‑윈 상황이라고 주장한다:

- 애플은 현재 최고의 AI를 기기에 통합하고, 구글은 수익을 창출한다.

- 이 거래는 10억 달러 규모로 평가되며, 이는 일시적인 해결책이거나 애플이 자체 모델을 계속 훈련하는 동안의 다리 역할일 수 있다.

- 특히, 애플은 OpenAI와의 파트너십을 종료하지 않았지만, 언제 어떻게 될지는 모른다…

출처

- Apple‑Google AI 파트너십 발표: CNBC

- 구글과 애플의 공동 성명: Google Blog

- Apple‑OpenAI 파트너십: OpenAI