Google의 최신 Tensor 프로세서는 친환경적인 접근을 취하지만, 비용은 어떨까요?

Source: Android Authority

C. Scott Brown / Android Authority

TL;DR

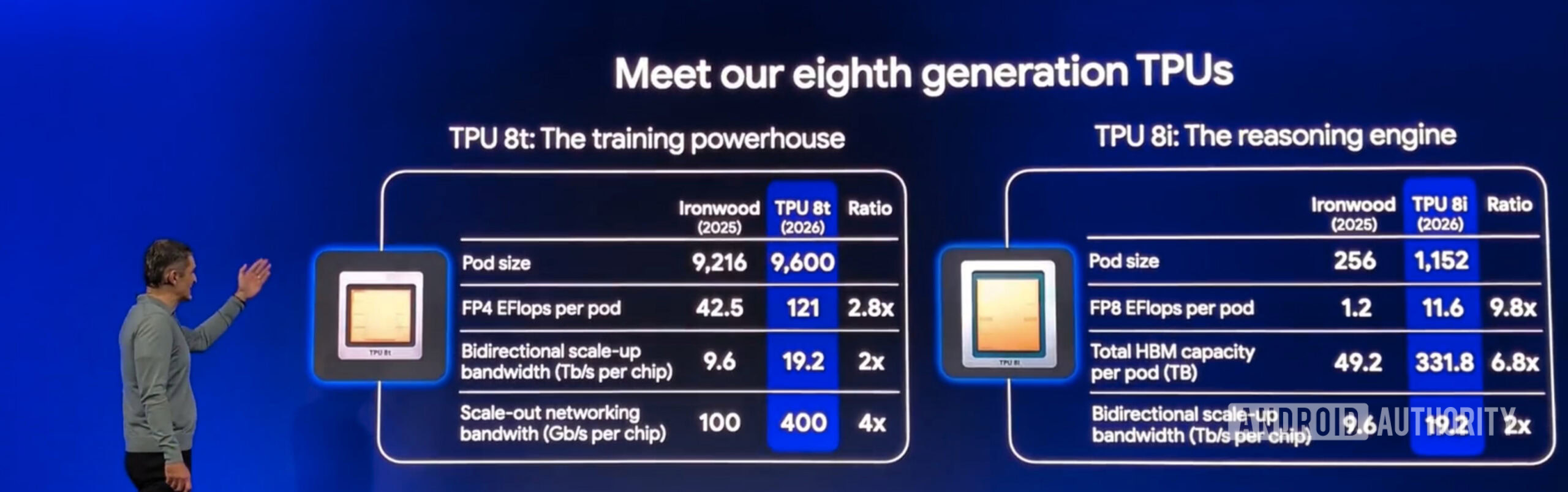

- 구글은 데이터 센터용 8세대 텐서 프로세싱 유닛(TPU)을 발표했습니다.

- 새로운 TPU는 용도에 따라 구분됩니다: 학습용과 추론용으로 각각 별도 유닛을 제공합니다.

- 구글에 따르면 이는 최종 사용자의 에너지 요구량을 줄여 환경에 도움이 된다고 합니다.

New eighth‑generation TPUs

Cloud Next 2026에서 구글은 두 가지 새로운 TPU 모델을 공개했습니다:

| 모델 | 주요 목적 |

|---|---|

| TPU 8t | AI 모델 학습 |

| TPU 8i | 추론(학습된 모델 실행) |

이와 같은 분리 아키텍처는 학습과 추론이 요구하는 전력 및 연산량이 다르기 때문에, 데이터 센터가 에너지 소비를 낮추고 운영 비용을 절감하며 AI의 환경 영향을 감소시킬 수 있도록 설계되었습니다. 이는 Gemini와 같은 서비스를 사용할 때 냉각에 필요한 물 사용량이 줄어들 수 있음을 의미합니다.

Training vs. inference

Training

신경망을 학습시키려면 높은 대역폭 메모리와 대규모 처리 유닛 클러스터가 필요합니다. 매초 수십억 개의 파라미터가 업데이트되기 때문입니다. 이 과정은 **오차 역전파(backward propagation of errors)**에 의존하는데, 이는 네트워크가 정확한 결과를 낼 때까지 반복적으로 조정되는 피드백 루프의 연속입니다.

오차 역전파에 대해 더 알아보기.

C. Scott Brown / Android Authority

Inference

추론은 그보다 덜 집약적이며, 메모리 소비가 훨씬 낮은 하드웨어에서도 실행될 수 있습니다. 학습과 추론을 동일한 하드웨어에서 수행하면 특히 추론 작업에 대한 비용이 불필요하게 증가합니다.

Comparison with previous TPUs

- TPU v5e – 소규모 작업을 위해 이전에 도입된 모델이며, “e”는 효율성을 의미합니다.

- TPU 8i – v5e 설계를 대규모에 맞게 확장한 것으로 보이며, 추론에 최적화되었습니다.

- 경쟁사 AWS Inferentia도 학습과 추론 워크로드를 분리하는 유사한 접근 방식을 취하고 있습니다.

Cost and environmental impact

구글은 전용 추론 TPU가 환경에 미치는 긍정적 효과를 강조하지만, 고객에게 비용 절감이 직접 제공될 것이라는 명확한 약속은 하지 않았습니다. 효율성 향상이 사용자에게 전달될지, 기업 이익으로 남을지는 아직 불투명합니다.